生成AIの利用はAPIを経由してのアクセスが基本となる。そこで重要になるのがAPIによるやりとりを管理するAPIゲートウェイだ。9月27日に開催された「Think IT Day AI for DevOps ~AIはアプリケーション開発・運用をどう変えるのか?~」(主催:インプレス Think IT)のKongのセッションでは、Kongソリューションエンジニアの橋谷 信一氏が登壇。「生成AIの活用とAPIライフサイクル」と題して、AI/LLMサービスを活用するためのKongのソリューションと、生成AIを含んだ新しいAPIエコシステムのあり方について解説した。

AI・LLMにアクセスする3つのパターンと

そこでAPIが果たす役割

生成AIの活用が進む中でAPIへの注目度が高まってきた。なかでも生成AIをサービスとして活用するためのAIゲートウェイの役割が重要になっている。

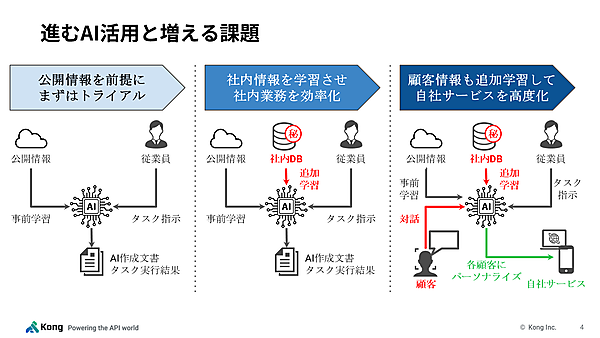

Kongのソリューションエンジニア 橋谷信一氏はまず、生成AIの現状について「多くの企業が早い段階から生成AIに取り組んでいます。パイロット的なアプローチを採用し、コストや業務効率化などメリットやROIが明確なところからトライを続けています。その過程でさまざまな課題も見えてきました」と切り出した。

課題としては、学習に向けた社内データの取り扱いが挙げられる。

「生成AIへのトライが成功すると、今度はそれを広げていく段階に入ります。そうすると、パイロット段階では扱いやすかったデータが、機微情報や社内の基幹システムなど取り扱いに注意な必要なデータに変わっていきます。社内のデータベースから生成AIにどう追加学習させるかといった課題に直面します」(橋谷氏)

さらに次の段階に入ると、学習するデータも社内データから顧客データなどに進んでいき、より多くの課題に直面することになる。

「有益な情報を顧客や外部に公開したり、顧客のユーザーエクスペリエンスを高めるために顧客データを活用したりします。ここまでくると、コストセンター的な意識からプロフィットセンターとして競争優位の獲得を目指すことになります。AIやLLM(大規模言語モデル)にアクセスする方法も複雑になっていきます」(橋谷氏)

そこでポイントになるのがAPIだ。

「AIやLLMにアクセスするパターンは3つあります。1つめはAPIを使って直接的に利用するパターン、2つめは学習やモデルに対して自分たちの知見をプッシュするパターン、3つめは生成AIからほかのサービスにつなげて機能を増強するパターンです。基本的にはすべてのアクセスがAPIを通して行われ、ガバナンスをどう確保するかが課題になります(図1)」(橋谷氏)

今後も増加することが見込まれる

API、ガバナンスをどう確保するかが課題に

橋谷氏は、AIやLLMへのアクセスに対するガバナンスについてこう解説する。

「ガバナンスとは、何か問題があったときに即時に対応したり、問題が起こらないように横断的に監視・観測したりすることです。生成AIを活用する際には、こうした非機能要件をどう組み込んでいくかが重要です。例えば、認証認可の仕組みがあります。組織の誰もがいかようにでも使えるかたちで生成AIにアクセスさせることはありません。また、コスト面からアクセス方法を変えることもあります。生成AIに毎回リクエストを投げるのではなく、結果をキャッシュして利用するといった方法です。さらに、LLMに機微情報が流れないように何かのバリデーションを行って利用するケースも考えられます」(橋谷氏)

こうしたAIアクセスにおける非機能要件を、個々のアプリケーションのなかで実装することは現実的ではない。ユースケースが異なるため、その都度開発が必要になるからだ。そこでカギになるのがAPIだ。橋谷氏は、APIはAIの進展とともに増え続けており、APIの要件も多様化、複雑化していると説明する。

「モバイルサービスやマイクロサービス、生成AIなど、新しいトレンドが生まれるたびにAPIの利用が増えてきました。APIの数は今後もさらに増えていくと予想されます。APIの数が増えると、APIという点をつなぐ線の数も増えます。今後はAPIがつながることでビジネスが成り立つ世界になり、それぞれの接続に対して、誰がアクセスすべきか、どけだけの権限でどれだけのアクセスができるのか、さまざまなルールを適用していく必要があります」(橋谷氏)

そのうえで橋谷氏はガートナーの調査を示し「すべてのAPIアクセスを管理することは困難であり、すでに組織のAPIの半数以上は管理対象外になっています。APIが新たな攻撃対象になるケースも増えています」とAPIを取り巻く課題が深刻化していると訴えた(図2)。

APIゲートウェイとして

世界で最も使われているKong Gateway

こうした生成AIとAPIをめぐる課題に対してKongではAPIゲートウェイ「Kong Gateway」を中心としたソリューションを提供している。

「Kong Gatewayは世界で一番使われているAPIゲートウェイです。このAPIゲートウェイでアプリケーション同士をつなぐことに加え、CNCF(Cloud Native Computing Foundation)の管理下で開発しているサービスメッシュ『Kuma』も提供しています。さらに、デスクトップ環境でAPIの設計やテストを行うプラットフォーム『Insomnia』も提供しています。Kongは、こうしたAPIを開発・設計し、運用し、管理する一連のAPIライフサイクルマネジメントの価値を提供する企業です」(橋谷氏)

Kong Gatewayの特徴は、軽量でどのような環境でも利用できることにある。Web/ProxyサーバーのNGINXをベースにして、拡張フレームワーク「OpenResty」を使ってAPIマネジメントやプラグイン機能などを備えている。

「Kong Gatewayのパッケージサイズは42MBと小さく、非常に低遅延で動作します。オンプレミス、マルチクラウド環境、Kubernetes環境、サーバレス環境で利用でき、CI/CDによる宣言的な構成管理が可能です。APAC地域では、厳しいリクエストを処理することが求められる金融機関で採用されるケースが多いです。また、プラグインモデルによってさまざまな非機能要件を実装することもできます。例えば、SSO、SAMLでの接続、流量制限、キャッシングなどを拡張機能として追加できます(図3) (橋谷氏)

これまでAPIゲートウェイの開発や実装には大きなリソースが必要だったが、Kong Gatewayを利用すると、さまざまなシーンで容易にAPIゲートウェイの構築・運用が可能になるという。

「特に、近年は、生成AIのように社内のリソースから社外のリソースにアクセスするシーンが増えたことをうけ、そこでKong Gatewayを利用するケースが増えています」(橋谷氏)

今後は生成AIに特化した

「AIゲートウェイ」が重要に

APIゲートウェイを生成AIの活用に向けカスタマイズしたものをAIゲートウェイと呼ぶ。KongではAIゲートウェイとして「Kong AI Gateway」を提供している。

「Kong AI Gatewayを利用すると、ユースケースに応じた生成AIの利用が可能になります。例えば、OpenAI、Cohere、Anthropicといった複数のLLMを使い分けたいというニーズや、今後登場する新しいLLMをすぐに採用したいといったニーズがあった場合、AI Gatewayを経由してLLMにアクセスする仕組みを作っておくことで、すぐに必要なLLMに切り替えて利用するといったことが可能です。また、生成AIを活用する際に課題となる流量制限や認証認可、データのバリデーションチェックなどをAIゲートウェイで行うことができます。さらに、生成AIを利用するコストをコントロールすることもできます」(橋谷氏)

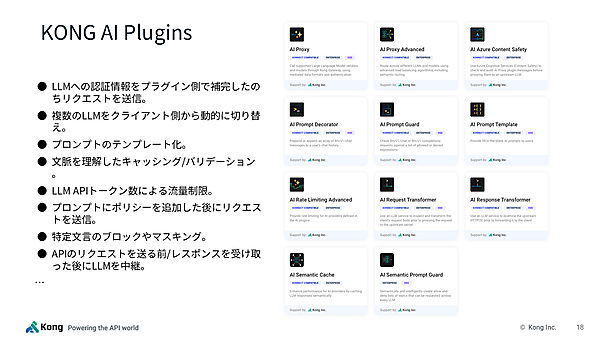

Kong AI Gatewayも、Kong Gatewayと同様にプラグインで拡張することができる。現時点では、複数のLLMの動的な切り替えや、APIトークン数による流量制限、文脈を理解したキャッシングやバリデーション、特定文言のブロックやマスキング、プロンプトのテンプレート化などが可能だ(図4)。また、Kongの年次イベントである「API Summit 2024」では、Kong Insomniaとの連携強化や、文脈を理解してキャッシュから回答を返すセマンティック系プラグインの強化も発表されている。今後、RAG(Retrieval Augmented Generation)作成に関するプラグインも提供予定だ。

このように、生成AIの活用に向けて、APIゲートウェイ、AIゲートウェイを中心にしたエコシステムをどう構築していくかがカギとなる。最後に橋谷氏は次のように話し、講演を締めくくった。

「われわれの出自はオープンソースです。技術を使ってもらってユーザーからのフィードバックを優先的に適用させるアプローチをとっています。現在、生成AIに関するフィードバックをたくさんいただいいており、プラグインでさまざまな拡張が可能になっていきます」(橋谷氏)

- この記事のキーワード