こんにちは、吉田です。今回は、Linux Foundationからリリースされた「2023年 オープンソースの生成 AI に関する調査レポート」について紹介します。

【参照】LF Research / LF AI & Data 調査レポート「2023年オープンソースの生成AIに関する調査レポート」を公開

https://www.linuxfoundation.jp/blog/2024/05/japanese-version-of-open-source-generative-ai-survey-report/

このレポートでは、企業における生成AIの現状と生成AIのオープン性に特に焦点を当て、この調査結果をまとめたものになります。OSI(オープンソースイニシアチブ)では、まだドラフト版ではありますが、オープンソースAIとは、システムをオープンソースであるためには、個別に以下の自由を求めるライセンスの下で利用可能にする必要があると定義しています。

- システムがどのように機能するかを学習し、そのコンポーネントを検査する

- どのような目的であっても、許可を得ることなくシステムを使用する

- システムを改変して推奨、予測、決定をユーザーのニーズに合わせて変更する

- いかなる目的であれ、修正あり、または修正なしでシステムを共有する

現在、さまざまな分野で生成AIが活用されていますが、下図のようにソフトウェア品質保証(35%)、ソフトウェアテスト(34%)、サイバーセキュリティ(31%)が含まれ、リスク軽減や製品・サービスの品質確保における活用されています。また、ソフトウェア開発(29%)とドキュメンテーション(34%)が注目すべき領域で、コード生成の自動化やアプリケーションやソースコードのドキュメントを作成しているということを考えると、品質や生産性の向上に大きく寄与していることがわかります。

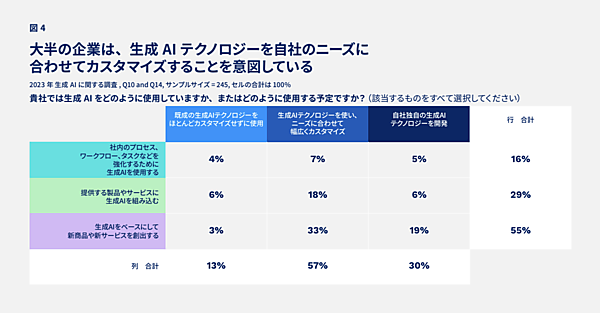

また、生成AIをどのように使用しているかという質問については、下図にあるようにニーズに合わせて幅広くカスタマイズ使用することを計画しています。自社ですべてを開発することについては、ハードルが高いことを考えると適切なアプローチであり、その場合はオープンソースに大きく依存することになると思います。使用方法についても新商品や新サービスを創出することを計画しているということで、カスタマイズして新商品を開発することが最も有効な活用法ということになるのかも知れません。

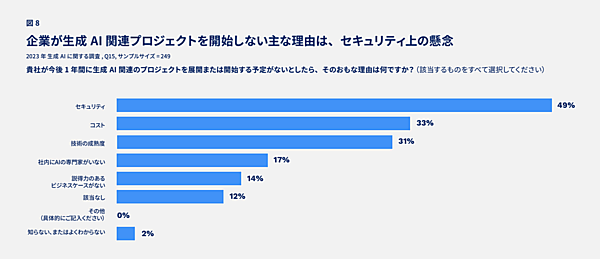

次に、生成AI関連プロジェクトを開始しない理由には、どのようなものがあるのでしょうか。下図に見られるように、やはり「セキュリティ」が一番の障害となっています。生成AIに関するセキュリティ上の懸念の具体的な例としてはプライバシー、信頼性、意図しない結果、データ侵害、悪用などが挙げられます。生成AIシステムは設計上、学習し最適に動作させるために膨大な量のデータを取り込むことになります。これらのデータには機密情報、安全でない情報、不正確な情報、または偏った情報が含まれている可能性があります。生成AIテクノロジーのセキュリティを確保することは技術的な必要性だけでなく、信頼と規制遵守を維持するために極めて重要なことになります。

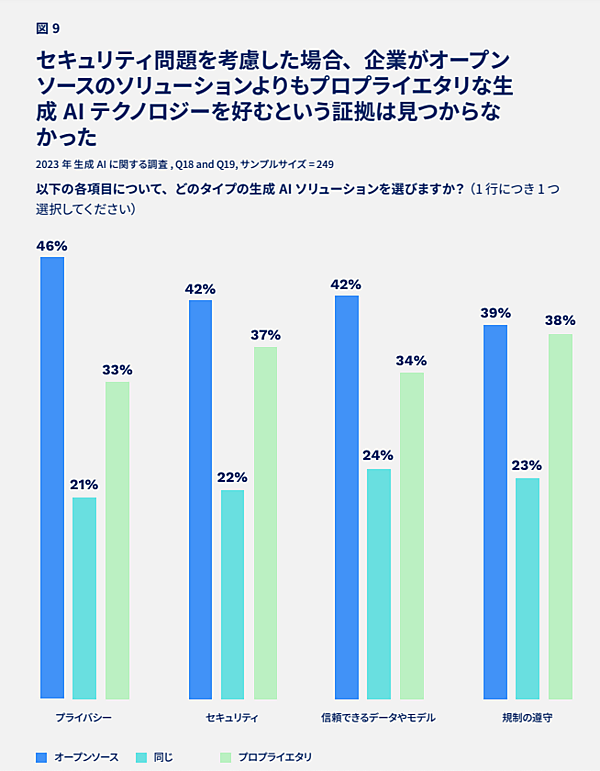

このように、セキュリティは大きな課題ですが、下図のようにセキュリティ、プライバシー、および規制コンプライアンスという重要な検討事項に関して、オープンソースよりもプロプライエタリなソリューションを好む傾向が強いという実質的な証拠はありませんでした。

生成AIのモデルがどのように意思決定を行っているかについての理解や透明性の欠如は、自分のデータがどのように使用されているかを知る個人の権利を妨げます。説明責任を果たすための適切なメカニズムがなければプライバシーが一貫して守られることを保証するのは困難で、一般的に受け入れがたいものになってしまいます。そこで、下図のように使用している生成AIの技術になった場合に69%がデータ管理や透明性が向上すると回答しています。

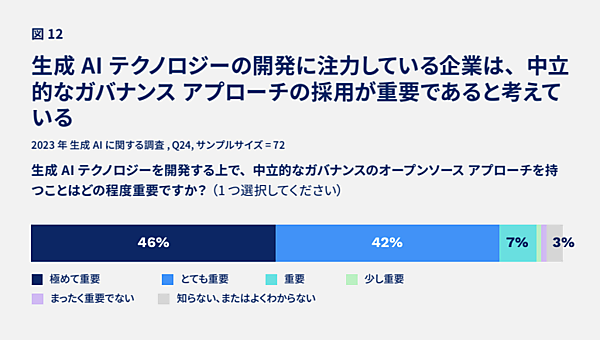

生成AIテクノロジーにとって透明性とアクセシビリティが重要であるのと同様に、オープンソースは生成AIから関連付けられるリスクを軽減するのに十分ではないかもしれません。下図では88%が生成AIテクノロジーを開発する際に中立的なガバナンスが非常に重要、または非常に重要であると回答しています。中立的なガバナンスはイノベーションが一部の企業だけに左右されないようにするために重要です。さらに、中立的なガバナンスはテクノロジーの悪用を防ぐための倫理的なスタンダードやガイドラインの設定にも役立ちます。また中立的なガバナンスは我々の調査で調査された様々な考慮事項と結びついています。

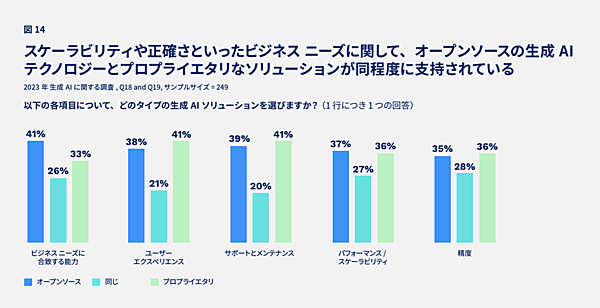

生成AIの有効性は、精度やスピードなどのパフォーマンス指標に基づいて多くの場合評価されます。下図は主要なビジネスニーズに関連して、どの程度支持されているかを表したものです。「精度」という視点ではほぼ同じように支持されており、プロプライエタリが36%、オープンソースが35%となっています。同様のパターンは「サポートとメンテナンス」「パフォーマンス / スケーラビリティ」などの他のカテゴリーでも同様の結果になっています。「ユーザーエクスペリエンス」に関しては、プロプライエタリなソリューション(41%)とオープンソースのソリューション(38%)を好む回答者がわずかに多くなっています。このように好みがバランスよく分散していることから、重要な技術的ニーズを満たす上でオープンソースのソリューションがプロプライエタリなものとほぼ同等に有利であると考えられている競争環境があることがわかります。

このように、さまざまな視点でオープンソースと生成AIの関連に関する調査結果がまとめられています。オリジナルの報告書には、さらに詳しく記述されていますので、興味のある方は、ぜひご一読をお勧めします。