KubeCon China 2024から、ロボットの操作に対し人間の動作を真似することで収集したトレーニングデータを大規模言語モデルに集約して開発を簡易化するフレームワークDoraについて、デモを交えて解説するセッションを紹介する。セッションを行ったのはフランスのAIベンチャー1ms.aiの創業者でパリに在住のHaixuan Xavier Tao氏だ。

DoraはDataflow-Oriented Robotic Architectureの頭文字を取って命名されているそうだ。名前が示す通り、手続き的にロボットの操作を行うのではなく、実際に人間が操作した際に得られたデータをデータフローとして使うことで、操作を実装するための複雑なプロセスを簡易化するためのフレームワークだ。フレームワーク自体はRustで開発されているが、ユーザーが行うロボットの操作の部分にはPythonを使うことで機械学習に慣れたエンジニアが直接Rustを触る必要がないようにするなど、エントリーのハードルを下げていると言える。

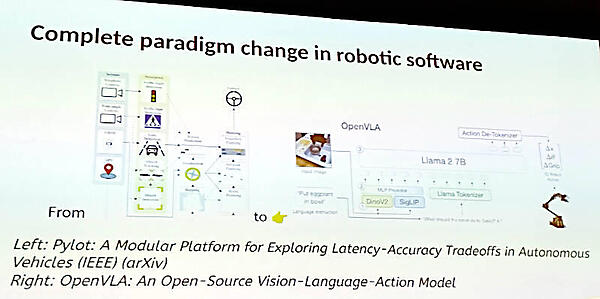

これまではロボット操作の高速化と遅延を極力抑える必要があったために多くの専用モジュールが使用されていたとして、それがロボット開発の難しさに繋がっていたことを説明。ここでは車輛の自動運転に必要なモジュールを例に挙げて説明しているが、OpenVLAと呼ばれるオープンソースの画像認識と言語による指示からロボットに対する操作命令を生成するモデルにおいてはその中核を大規模言語モデルで置き換えることが可能になっていると解説した。

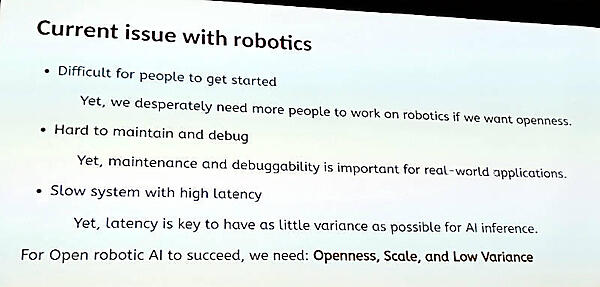

そして現在のロボティクスの問題点を整理したスライドを使ってDoraの利点の前提を解説した。

Tao氏はロボティクスの開発にもっと多くのエンジニアが参加して欲しいと考えており、そのためには参入のハードルを下げること、デバッグを簡単にすること、高速化、低遅延が必須であることなどを課題として挙げた。

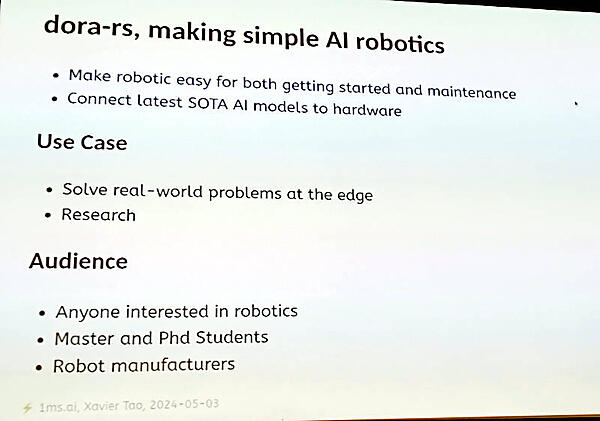

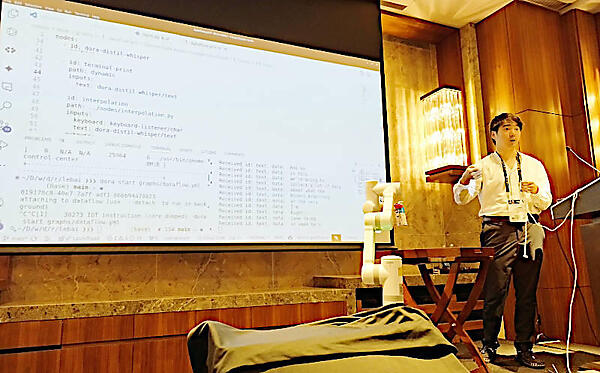

ここでdora-rsの概要を紹介するスライドを使っているが、容易に始められること、デバッグを簡単にすること、最新のモデルとハードウェアを使うことなどの特徴がどのように実装されているのかについては詳しい説明がなかった。これは後半のデモに時間を使いたいというための選択だろう。実際にこの後は、持ち込んだロボットアームを使って音声でコマンドを出して操作するという内容となった。

唯一残念なのはデモに集中するあまり、壇上のマイクから離れてしまうことで音声がかなりの部分拾われていないことだろう。現地では客席の前方で観ていた筆者も何度か「マイクを使って欲しい。そうしないと音声が録音されない」と言いそうになったほどだ。動画でもデモの中のかなりの部分の音声が聞こえないような状況だ。

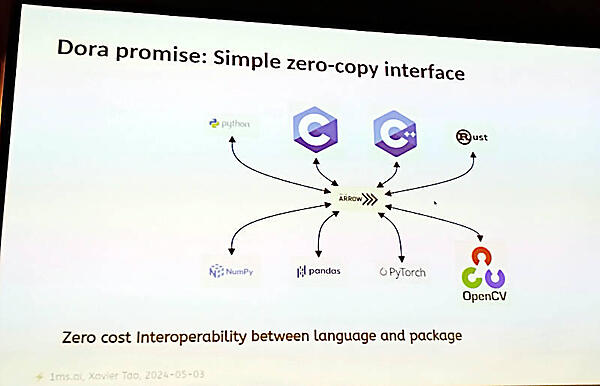

実際に構成情報やPythonのコードを見せながらロボットアームに対して「Up」や「Down」「Left」「Forward」「Back」などの動作を命令し、その通りに動くというデモを実施。ここでは音声でロボットが動くことそのものよりも、それが大規模言語モデルによって駆動されていることがポイントだろう。また複数のプロセスがノードを超えて連係する部分には、Apache Arrowが使われていると説明。ここでもオープンソースのエコシステムを最大限に活用していることを見せた。

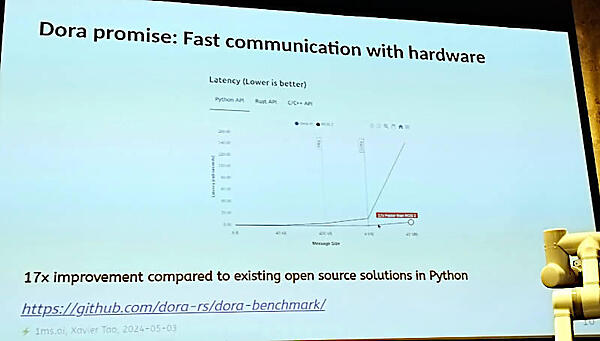

処理速度、遅延についてはベンチマークの結果を見せて、メッセージ交換については他のツールよりも17倍も性能が向上したことを説明した。

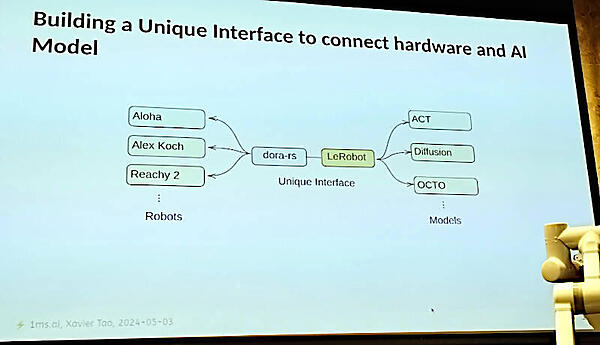

また大規模言語モデルとロボット操作のための機能を繋ぐ部分には、LeRobotというHugging Faceがホストするオープンソースのツールを利用しているという。

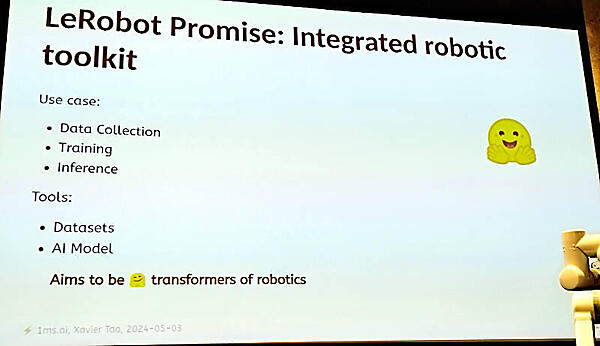

そのLeRobotについても簡単に紹介を行った。

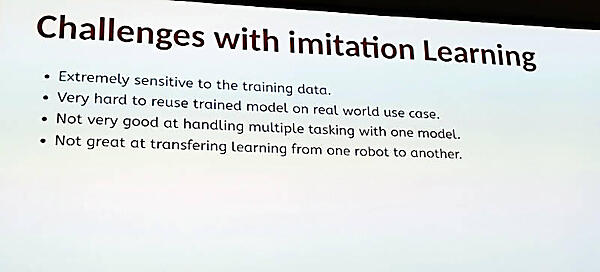

ここで人の動きを真似(イミテーション)することで、データのトレーニングを行うという手法についての課題を紹介。トレーニングされたデータを実際に使うことに対する抵抗や複数のタスクを一つのモデルで実行する難しさ、他機種のロボットへの移植の難しさなどを挙げて、この手法が必ずしも最適の選択ではない可能性もあることを示唆していると言えるだろう。実際に小さな牛乳パックをアームが掴むというデモをみても従来型のシステムとの違いは見つけ難く、今後の進化や応用の拡がりに期待するべきという内容となっていた。

唯一興味深かったのは牛乳パックを持つロボットに「Face」というコマンドを出すことでそのアームの位置を記憶させ、他の動作を行ってアームが移動したとしてもコマンドだけで元の位置にアームをリセットさせられるという部分だろう。これは文脈を維持したまま質問を続けることが可能な大規模言語モデルらしさが出たデモとなった。

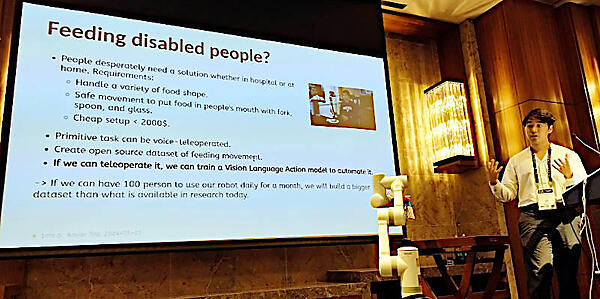

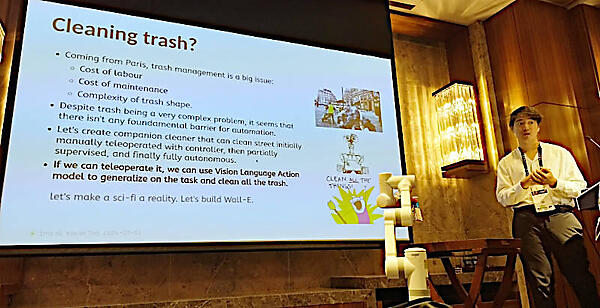

そして実際にこの手法で何を実現したいのかという部分には、障害者への食事の提供やTao氏が住むパリのゴミ掃除をロボットにやらせるなどのアイデアを紹介した。

パリの路上のゴミ掃除については、深刻な社会問題となっている課題に合わせてフランス語で指示をしなくても手話のような合図を使って指示が出せるようになることで、より利用が容易になることを説明。移民問題で揺れているフランスの社会事情を垣間見た瞬間となった。

ただプロジェクト自体は現在開発中ということで、2024年10月に中国の大学とのハッカソンが予定されていることや2025年1月に実証実験、2025年の中ごろにはオープンソースのモデルとして公開を予定していると説明した。

セッション全体としてはデモが成功したことなども含めて楽観的な気分の内容となったが、実際に人間と接触する応用例ではエラー処理や緊急停止などの安全対策などにまだまだ時間がかかるだろうということを感じさせる内容となった。

公式のGitHubページは以下を参照して欲しい。

●公式GitHub:https://github.com/dora-rs/dora

●公式ページ:https://dora-rs.ai/