はじめに

前回は「Transformer」という自然言語処理やAttentionの仕組み、RLHFという強化学習を解説しました。今回は、マイクロソフトの新しい「Bing」や「Copilot」について解説します。これらはGPT-4を搭載していますが、GPT-4そのままではなくいろいろと便利な仕組みを備えています。

Microsoft Bing の「検索」と「チャット」

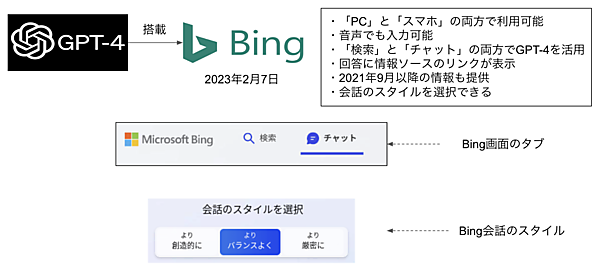

マイクロソフトは、2023年2月7日にAIを搭載したBing検索エンジンとEdgeブラウザをリリースしました。図1の「Bing画面のタブ」に示すようにBing画面上部に「検索」と「チャット」がタブ切り替えられるようになっていて、「検索」がGoogle検索のようなキーワード検索、「チャット」がChatGPTのような会話機能となっています。

前述したように、新しいBingはGPT-4を搭載しています。月20ドルを払って「ChatGPT plus」を使わなくても、無料でGPT-4の優れた機能を体験できるので、より多くの方がGPT-4の実力に触れる機会を得られます。PCとスマホの両方で利用でき、音声でも入力できます。回答に情報ソースのリンクが含まれているのも便利で、怪しい回答だなって思ったらリンクを開いてネタ元を確認できます。

一番のメリットは、最近の情報にも対応できることです。ChatGPTやGPT-4は2021年9月までの学習データでトレーニングしたモデルですが、Bingはインターネットにアクセスできるのでネットの最新情報を利用して2021年以降に関わる質問でも回答できます。

Bingの特徴は「チャット」と「検索」を切り替えて使えるようにしている点です。「チャット」と「検索」はそれぞれ利点があります。チャットは質問に対してチャットAI(大規模言語モデル)が最適と思われる回答をしてくれるので、自分でいろいろなホームページを読んで最適な答えを探す手間が省けます。一方で、どのような質問にもチャットAIがベストの回答をしてくれるとは限りません。質問によっては、これまでの検索のように検索キーワードにヒットした上位のページを参照して自分で答えを見つける必要があります。

チャットAIの精度が向上すれば、いずれはチャット一本になるかも知れませんが、(Google検索と勝負するためにも)「検索」と「チャット」両方の利点を使えるようにしたのはすばらしい判断だったと思います。

2023年3月2日からは、図1「Bing会話のスタイル」に示すように、会話のトーンを次の3つから選択できるようになりました。

- より創造的に(More Creative)

- よりバランス良く(More Balances)

- より厳密に(More Precise)

3つのスタイルの違いは、チャットAIを人だと思うとイメージが湧きます。思いもかけない発想をする想像力あふれる人と、その逆に真面目で固いけど正しいことを言う信頼できる人、そしてその中間のバランスの取れている人という感じです。

この3つは、試してみると結構違います。例えば「梅雨の合間の晴れの日を楽しむ俳句を作ってください」とお願いしたところ、次のような回答でした。みなさんはどれが一番好きですか。

Creativeくん:梅雨明けぬ 青空広がる ひまわり畑

Balancesくん:梅雨明けや 蝉しぐれ 響く山

Preciseくん:梅雨空に 晴れ間がのぞく 嬉しさよ

ChatGPT(GPT-3.5)くん:雨過ぎて 雲の切れ間に 空の輝き

ChatGPT(GPT-4)くん:梅雨明けき、隙間の青空、心浮かべ

複数作ってくれることもあって、その場合は私がその中から1つ選んでいます。CreativeくんとBalancesくん、GPT-4くんは「梅雨の合間」という言葉を理解できてなくて梅雨明けという言葉を使ったので、ここではPreciseくんとGPT3.5くんに軍配が上がりますね。でも、別のお題ではPreciseくんはお題を5・7・5調に並べただけの面白くもなんともない回答だったりします。また、5人とも同じお願いをするたびに作ってくれる俳句が変わるのも人間っぽいと感じさせてくれます。ちなみに、私はこの5つの中ではCreative君の俳句が情景が浮かんで一番好きでした。

これからの時代、文章を作成する際にチャットAIを手助けに使うことが増えていくと思います。そのような場合に、ある1人だけに頼るよりも3人のヘルパーに質問してそれぞれの回答を並べて比較する方が、より優れた文章を作ることができそうです。

Bingの検索AI「プロメテウス(Prometheus)」

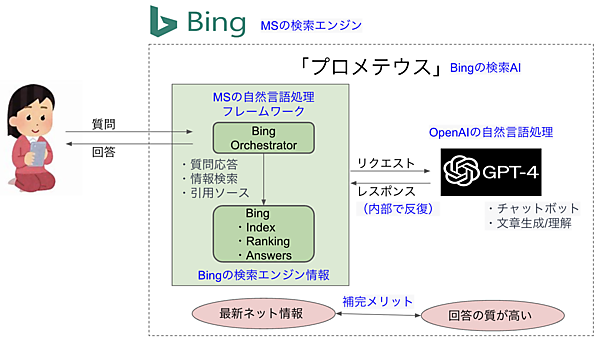

新しいBingの「検索」や「チャット」は、従来からあるBing検索エンジンにGPT-4を組み合わせたプロメテウス(Prometheus)という機能に切り替わっています。図2を使ってプロメテウスの仕組みを説明しましょう。

Bing Orchestratorは、マイクロソフトの自然言語処理フレームワークです。ユーザーからの検索クエリを受け取り、Bingの検索エンジンの情報(インデックス、ランキング、アンサー)と背後にあるGPT-4の回答を組み合わせてユーザーに回答します。両者の違いは、GPT-4はチャットや文章生成など高度な自然言語処理ができる汎用モデルであり、Bing Orchestratorはユーザーの質問応答や情報検索などのタスクに特化したモデルです。

Bing OrchestratorとGPT-4で数回やり取りして回答を作る方法はGroundingと呼ばれており、Bingがネット検索で得た最新情報(Answers)を提供し、高度な自然言語処理能力を持つGPT-4とで複数回やり取りして不正確さを減らすことができます。

この2つを組み合わせた補完関係のメリットは2つあります。1つはBingの回答の質を大幅に向上させることができた点です。従来のBingのAnswerに比べて、優れた言語モデルであるGPT-4がさらに高度な内容を返してくれるので、これまでに比べて格段に満足度の高い応答が得られるようになりました。

もう1つはGPTシリーズがある時点のトレーニングデータしかネタがないという弱点をカバーできることです。ChatGPT/GPT-4はトレーニングデータが2021年9月までと古いです。しかし、Bingはインターネット上の最新データを利用できるので、ユーザーからの検索に対してきちんと新しい情報を使って回答できます。

さらに、Bingが引用したソースのリンクを表示してくれるのもとても重宝します。ChatGPTは、Common Crawlコーパスなどのデータから学習しているためネタ元を表示するのは難しいですが、Bingはネットから新しい情報も獲得しているのでリンクを表示できるのです。

Bingは1トピック内のやり取り回数に20回という制限がありますが、20回に達しても1回クリアして新しいトピックとして質問できます。マイクロソフトのブログによると、これはケチケチしているわけではなく、チャットセッションが長くなるとAIチャットの回答精度が下がる可能性が高くなるからだそうです。前回Attentionの説明で使った婚活パーティの例で言えば、ステージ上から相性の良さそうな相手を見つけるのは200人だと効率が良いですが、2000人だと多すぎて見落としが増えるという感じでしょうか。

なお、Orchestratorという言葉は「編曲家」の意味で、Prometheusはギリシャ神話の男神です。こちらは漫画のワンピースでも火の化身として登場していますね。

私が最初に利用していたブラウザはマイクロソフトのInternet Explorer(本当はその前のNetscape Navigatorですが)で、検索サイトはYahoo! 検索でした。やがて彗星のようにGoogleが現れ、検索の優秀さからGoogle検索に切り替え、動作の速さからブラウザもChromeに切り替えて現在に至っています。

世界のシェアを見ても、この最強タッグは長らくトップシェアを維持しており、このまま揺るぎないものと思われました。しかし今、私は検索の主役をBingチャットに切り替え、これまで敬遠していたEdgeも使い始めています。マイクロソフトは長い間、Google検索&Chromeブラウザコンビに苦渋を飲まされ続けていましたが、Open AIを味方につけてようやくBing検索&Edgeブラウザコンビにも逆転のチャンスが来たようです。

実はEdge&BingではなくChrome&Bingという組み合わせでもBingを利用することもできます。私は自宅ではChromebookを使っているので、「Bing Chat for All Browsers」というChromeの拡張機能(無償)でBingを使っています(会社ではEdgeとChromeの両刀遣い)。

自分でも驚きなのですが、現在、私が何かを調べるのに最初に使うのはBingチャットです。一発で回答が返ってくるので、検索結果で表示されるページを見て回る手間が省けて重宝しています。

最近の情報に関するBingとChatGPTの違い

マイクロソフトは2023年2月21日のBingブログで「新BingはGPT-3.5より優れたAI」と表現していましたが、翌月のブログでこれがGPT-4であることを明らかにしました。このブログでwe’ve customized for searchという表現を使っている通り、「検索」だけでなく「チャット」でもBingがネットから集めた情報を活用して回答してくれます。

連載第1回で2023年5月2日に「日本の総理大臣は誰ですか」という質問をChatGPT(3.5)にしたところ、「2023年5月現在、私が取得している情報によれば、日本の総理大臣は菅義偉(すが・よしひで)氏です。」と誤った回答が返ってきたことを紹介しました。2021年9月までの学習データしか勉強していないくせに、わざわざ「2023年5月現在」というもっともらしい前置きを付けて誤答するのがChatGPTらしいですね。

ところが今回(7月)に同じ質問をしたところ、今度は「2021年9月時点での情報ですが、日本の総理大臣は菅義偉(すが・よしひで)氏でした。ただし、私は2021年9月までの情報しか持っていないため、現在の状況を正確に反映しているかは保証できません。」という回答でした。なんと“平気で嘘をつく態度”が改まっています。前回で解説したRLHF(強化学習)による行儀作法の訓練が引き続き行われているということなのでしょう。

ちなみに、同じ質問をChatGPT-4に行ったところ、「私の情報は2021年9月までのもので、その時点での日本の総理大臣は菅義偉さんでした。現在の総理大臣については最新の情報をご覧ください。」という、似たような回答でした。ChatGPTに比べて性能は格段に上がっていますが、学習データが古いという弱点は今のところ克服されていません。

一方で、Bingのチャットは「現在の日本の内閣総理大臣は、岸田文雄(きしだ ふみお)氏です。」と正しい回答とともに情報ソースのリンクを付けてくれます。回答の文言は「創造的に」「バランスよく」「厳密に」によって異なり、同じスタイル(例えばバランスよく)に対して同じ質問を2度投げても微妙に回答は変わりますが、どれもネットの最新情報を利用した正しい回答です。

BingとGPT-4の比較

今度は最近の情報に関わらない質問をしてみましょう。BingはGPT-4を搭載しているので同じレベルの回答を得られるような気がしますが、実際のところはどうでしょうか。

図3はGPT-4とBingに「あなたが主婦だとして、牛もも肉、ピーマン、レタスを使った料理を提案してください」という依頼をした際の回答です。GPT-4は1品に絞って詳細なレシピを教えてくれたのに対し、Bingは“料理を提案して”という依頼をそのまま受け取って3品の料理を提案してくれています(その代わり詳細なレシピはなく、知りたかったら追加質問でということでサジェスチョンが表示されています)。

こうして比較してみるとかなり違いますね。どちらが良いかは人の好みやシチュエーションによりますが、BingがGPT-4を搭載しているからと言って、質問と回答を丸投げしているわけではないことが分かります。

なお、私は日常的に両者を使い分けていますが、全般的にChatGPT(3.5/4.0)の回答の方が詳細で長く、Bingはまず簡潔に回答して追加質問で掘り下げる方針にしているようです。

Microsoft 365 Copilot

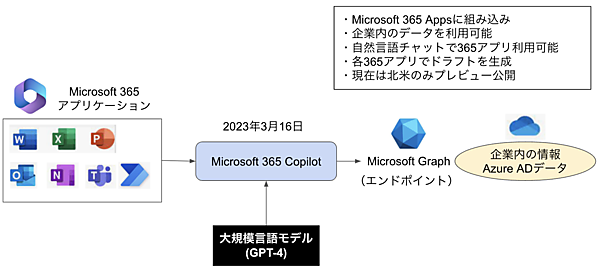

マイクロソフトは、新Bingを発表した1ヶ月後の2023年3月16日に同じくGPT-4を搭載した「Microsoft 365 Copilot」を発表しました。これはMicrosoft GraphやMicrosoft 365アプリケーションに大規模言語モデル(LLM)を利用した自然言語インターフェースを搭載して、より便利に活用しようというものです。

Microsoft 365 Copilotの構成と役割

図4にCopilotの全体構成をまとめたので、これを使ってポイントを説明しましょう。

a.Bingと同じくGPT-4を搭載している

b.Microsoft 365アプリケーションに組み込まれている

c.365アプリケーションの操作や作成を支援する

d.Graphを通して企業内のAzure AD(Active Directory)データを利用できる

e.Copilotで使った入力は機密保持のためにマイクロソフトに保存されない

BingがGPT-4の学習データにプラスしてWeb上の情報を利用できるのに対し、CopilotはGPT-4の学習データにプラスして企業内に蓄積されている情報を利用できます。また、Bingが汎用のチャットサービスなのに対し、CopilotはMicrosoft 365の利用をチャットというUIで支援する役割に特化したものです。そして機密性の高い企業のデータをターゲットにしている分、Copilotに使った入力テキストはマイクロソフトでは保存せず、ドキュメントの内容や記述した説明も機械学習に使用されることはありません。

Microsoft Graphは、Microsoft 365データを含むAzure AD(Actiive Directory)のデータにアクセスできるエンドポイント(接続デバイス)です。ユーザーはMicrosoft Graphを利用して、Microsoft 365サービス全体に保存されているデータにアクセスできます。また、ユーザーのシステムからも利用できるようにMicrosoft Graph APIも用意されています。

Microsoft 365 Copilotの支援内容

実際、Word、Excel、PowerPoint、Outlook、TeamsなどのMicrosoft 365アプリケーションにcopilotが組み込まれると、どのようなことができるようになるのでしょうか。

1つは、チャットUIを活かしたアプリケーションに対する操作です。例えばExcelに「1行目を固定して」「この表でグラフを作って」などとチャットで指示できるので、操作方法を熟知していないユーザーの作業がかなり楽になります。また、日常的にアプリケーションを使っている人にとっても、普段の自分では考え付かないような便利な方法を教えてもらう機会が増えるでしょう。

もう1つは、生成AIの創造性を活かした文章作成やアイデア創出です。例えば、要点をプロンプトで伝えて報告文書を生成してもらったり、プレゼンの構成を提案してもらったり、パワーポイントのドラフトを作成してもらったりできます。ドキュメント作成の手間を大幅に削減できるほか、普段の自分では考えつかないようなアウトプットを見せてくれます。

システムや機械に「チャットや音声で指示」というUIはこれまでにも見られましたが、チャットAIの特徴は指示が1回と限らない点です。Copilotが提案したドラフトに「もっとこうして」「こういう要素も入れて」などとやり取りしながら、企業内データを活用しながら完成度を高めていけるので、自分ではとても作れないような品質の高いドキュメントを作れたりします。

Microsoft 365 Copilotの利用イメージ

図5に、Copilotの利用イメージの一例を紹介しています。

a.オンライン会議の議事録

「会議の議事録を取って」と指示することで、Teamsのオンライン会議内容を元に議事録をとってもらえます。だらだらと続く会話の要点をまとめてリアルタイムにOneNoteなどに表示してくれるほか、掘り下げてこういう質問をした方が良いというようなリコメンドも出してくれます。

b.対話でアプリに操作指示

Excelなどに対話形式で操作指示を出すことができます。自分で操作するのと比べてあっという間に操作が行われるだけでなく、普段の自分が思いつかないような便利な機能を使ってくれるので、大幅に操作効率がアップします。

c.対話で文章を作成

Wordなどに要点を伝えてドラフトを作成してもらったり、長文を要約してもらったり、アイデアを提案してもらったり、さまざまな目的でCopilotに文章を作成してもらえます。操作だけでなく、生成に関しても自分が思いつかないようなアイデアを出してくれ、対話型でそれを高めて行けます。

d.RPA作業を自動作成

自動化ツールPower AutomateもMicrosoft 365の1つです。RPAの難点は自動化を設定する作業が大変というところですが、チャットUIを通じて複数のアプリケーションを組み合わせたPower Automateの自動化を作成できます。

e.パワーポイントの作成

要点を伝えてパワーポイントのドラフトを作成したり、製品の仕様書(Word)を元にプレゼン資料を作成したりできます。パワーポイントの作成はデザイン力も必要になりますが、自分ではできないような創造性の高い資料を対話しながら作成できます。

f.メールの模範解答の作成

チャットAIに役割を与えると、その役になりきって会話をしてくれます。例えば、Copilotにカスタマーサポートの役割を与えて、ユーザーからの問い合わせに対する回答を作成させると、企業内のデータを活用して模範回答を作成してくれます。

残念ながらCopilotは現在、英語版を北米のみにプレビュー公開している状況ですが、そう遠くないうちに日本でもサービス開始すると思われます。そして公開後も進化し続けることが予想されるので、ホワイトカラーの生産性が大幅に向上することが期待されます。

実は、現在でもBingにExcelの行固定のやり方を聞くと図6のようにわかりやすく答えてくれます。これだけでも大変ありがたいのですが、CoPilotがサポートされれば、指示するだけで操作まで自動的に行ってくれるようになるわけです。

まとめ

今回は、以下の内容について学習しました。

- Microsoft BingはGPT-4を搭載し、検索とチャットを切り分けて使える

- 生成で利用するときはBingのスタイル(創造的/バランス/厳密)を3つ試すと便利

- Bingはプロメテウスという仕組みにより、最新情報を使った回答をしてくれる

- Bingはネタ元のリンクや追加質問のためのサジェスチョンも表示してくれる

- 一般にGPT-4の回答は長く詳細で、Bingの方が簡潔な回答を返す

- Copilotは、Microsoft 365を便利に使いこなすための専用AI

- Copilotを使えば、特定データ(企業内365のデータ)を活用できる

- Copilotとの会話内容は、機密保持のためにAIの学習データには使われない

今回は、マイクロソフトのBingとCopilotを中心に解説しました。私は昔からGoogle派なのですが、日常の検索にはBingチャットを活用しています。これからAIチャットはさらに進化、発展していきますので、今のうちに「AIチャットの日常使い」に慣れておくと良いでしょう。