はじめに

前回のテーマの音声認識(Speech to Text)が聞く技術なのに対し、今回のテーマは、話す技術の音声合成(Text to Speech)です。実は音声認識よりもさらに実用化が進んでおり、日本語のハンディもあまり感じられない技術でもあります。利用範囲が非常に広く市場も大きいので、その分、競争が激しくて多くの企業がしのぎを削っている状況です。

音声合成方式

(1)録音編集方式とテキスト音声合成方式

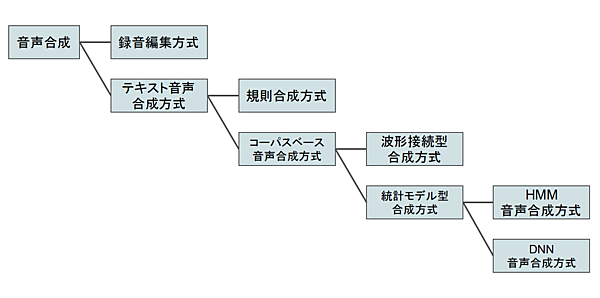

図1は音声合成方式の発展の様子を体系化したものです。音声認識と同じく音声合成もかなり前から取り組まれていて、最初の基本的な方式は「録音編集方式」と「テキスト音声合成方式」の2つでした。

前者は単語やフレーズを録音したものを音声データとし、それらを組み合わせて言葉にするつぎはぎ方式です。録音した音声ベースなのでそれらで作れる言葉に限定されますが、イントネーションが少しおかしい点に目をつぶれば肉声なので自然な音声になります。後者はテキストを読み上げて音声にする方式なので、どのような言葉でも対応できるメリットがあります。最初はあらかじめ定めた規則にもとづいて音声波形を合成する「規則合成方式」で、これは機械が読み上げている感が強いものでした。私たちの世代だと馴染みが深くタレントが真似したりもする音声ですが、たぶん、これからの若い世代には真似しても「???」という顔をされるのでしょうね。

(2)コーパスベース音声合成方式

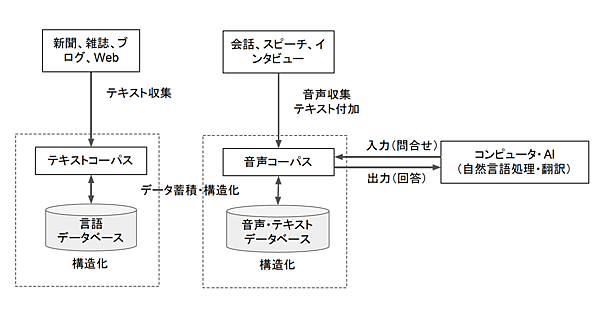

続いて登場したコーパスベース音声合成方式は、ぎこちなさを解消して自然な感じの音声を作れる画期的な技術で、現在、幅広く使われている技術のベースとなっています。こちらは、まず会話やスピーチ、インタビューなどの音声データを集めた音声コーパスと呼ばれる大量の音声データベースを作成しておきます。そして、テキストを入力したときにその中に格納された音声波形を使って音声を合成します。

コーパスとはテキストを集めた大規模言語データベースです。新聞、雑誌、ブログ、Webなどのテキスト文を大量に集めて、コンピュータが利用しやすいように構造化して格納しています。そして、文字データだけではなく音声データも集めたものが音声コーパスになります(図2)。

実はコンピューターやAIが自然言語処理や機械翻訳を行うときは、このコーパスを参照しています。そのため、コーパスは各国語で作成されています。

コーパスは網羅的に言葉を収納する辞書と違い、日常よく使われる言葉がデータベース化されています。その国のネイティブがよく使う現代的なフレーズが入っているので自然な会話ができるのです。よく使うフレーズは格納量が多いため、コーパスに問い合わせたときに確率的に高い使いまわしとして回答が返ってきます。これもGoogle検索と似ていますね。

コーパスはもともとは言語研究者のために作られており、用途によっていろいろな種類があります。例えば、国立国語研究所で作成したコーパスには「現代日本語書き言葉均衡コーパス」や「日本語話言葉コーパス」、「日本語ウェブコーパス」など多数の種類があります。

人間もコーパスを電子辞書を引くような感覚で使うことができます。例えば、小学館コーパスネットワークでは、数億語の英語のコーパスを利用できるサービスを提供しています。

(3)波形接続型合成方式と統計モデル型合成方式

コーパスは、音声データベースを使うと言っても録音編集方式ではないので、そのまま音声を再生するわけではありません。方式としては波形接続型合成方式と統計モデル型合成方式があります。

波形接続型は音声を波形データとして音素単位に分割して音声データベースに格納します。そしてテキストが入力された際に、その音素を組み合わせて音声にします。その際に、ただ単純に波形を組み合わせると不自然になるので、アクセントや構文などの情報によりもっとも適切な組み合わせを抽出します。

統計モデル型は、データをもとに学習して推論モデルを作り、そのモデルを使って推論する機械学習モデルです。学習プロセスでは、音声データベースのテキスト・音声を使ってテキストと音声の関係を機械学習して音響モデルを作ります。関係とは、テキスト解析により取り出した単語や品詞と音声から抽出した音響特徴量の関連です。この関係を機械学習して、テキストから音響特徴量を推定し、それをもとに音声波形を合成する音響モデルを作成します。

推論プロセスでは、学習プロセスで作成した音響モデルを使います。任意のテキストを入力すると、適切な音声を合成して出力してくれるわけです。

(4)HMM音声合成方式とDNN音声合成方式

統計モデル型合成方式にはHMM方式とDNN方式があります。HMMは隠れマルコフモデル(Hidden Markov model)と呼ばれる学習アルゴリズムを使ったもので、これがこれまで音声合成方式として幅広く使われていました。一方、DNNはディープニューラルネットワーク(Deep Neural network)、すなわちディープラーニングを使った学習モデルで、最近は徐々にこちらの方式が増えています。

コーパスは対象を絞って作成すればするほど自然な音声を合成できます。例えば、医療診断用の音声を合成するには、医療診断で使われるていねいな言葉を冷静な音声で収録したコーパスの方が、友人同士の会話や怒りや悲しみのスピーチが混ざったコーパスより適切な音声になります。

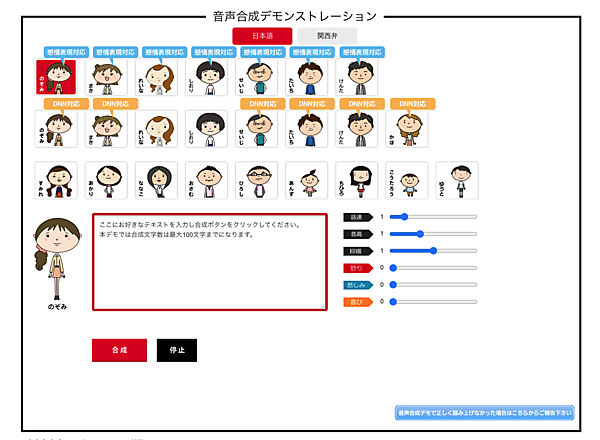

また、喜びや悲しみなどの感情を持たせて発声した音声で「感情ごとのコーパス」を作り、入力されたテキストを感情分析して適切なコーパスに切り替えて反応する「感情表現対応」も盛んに行われています。

音声合成サービス

日本語の音声合成は古くからいろいろな企業が取り組んでいましたが、最近はAI技術を引っさげて新規参入する企業も相まみえて群雄割拠という状況になっています。AIによる音声合成は、ちょっと前まではGoogleやAmazon、Microsoftなどの海外企業がリードしていた感があったのですが、日本語に関しては日本企業も負けていない状況になっています。

(1)音声合成を体験

音声合成の多くは各社のホームページでデモ体験ができます。前回も言いましたがエンジニアは何事もトライするのが大切です。有料と無料のサービスを2つ紹介しますので、どれくらい自然な音声が出せるか実際に体験してみましょう。

・AI Talk

AI Talkは、株式会社エーアイの音声合成ソリューションです。ホームページに図3のような音声合成デモンストレーションがあり、自分で入力したテキストをいろいろなキャラクターの音声で聴くことができます。

図3:AI Talkの音声合成デモンストレーション【出典】株式会社エーアイのWebサイトより

・音読さん

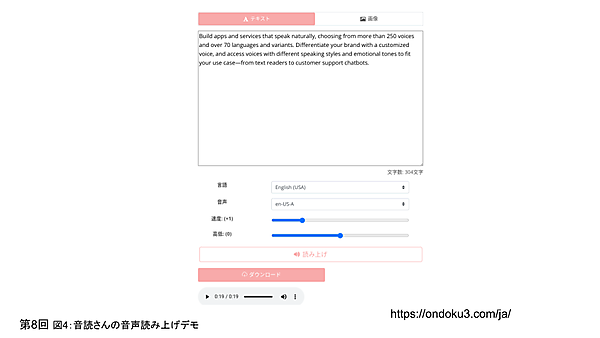

音読さんは、無料で5,000文字まで音声読み上げが可能なソフトです。クレジット表記すれば商用利用も可能なので、例えば音読さんの音声で動画のナレーションを制作することもできます。日本語や英語、中国語、フランス語など多くの言語に対応しています。

こちらもホームページのデモで試してみましょう(図4)。ここではMicrosoft Cognitive ServicesのText to speechページに書かれている英文を読み上げてもらいましたが、とても流暢でした(ネイティブじゃないので真価はわかりませんでしたが)。

図4:音読さんの音声読み上げデモ【出典】音読さんのWebサイトより

音声合成エンジン

音声合成ソフトは山ほどあると言いましたが、表1に主なものをリストアップしました。厳密に言うと、音声合成ソフト/サービスと音声合成エンジンは分けて捉える必要があります。音声コーパス技術を使って独自に音声合成を実現するものが音声合成エンジンで、それを使って音声合成を提供するのが音声合成ソフト/サービスです。

音声合成エンジンは、クラウドのAPIだったり、機器に組み込んだり、スマホで使えるようにしたりとさまざまな提供形態があります。例えば、AI TalkはAI Talk5という独自の音声合成エンジンですが、棒読みちゃんやSoftalkなど無料ソフトの多くは無料の音声合成エンジンを使っています。

表1:主な音声合成エンジン

| 音声合成エンジン | 開発元 | 主なソフト |

|---|---|---|

| AquesTalk | 株式会社AQUEST | ・棒読みちゃん ・Softalk |

| Open JTalk | 名古屋工業大学 | ・テキストーク ・SHABERU |

| Google Text to Speech | ||

| Cognitive Services Text to Speech | Microsoft | |

| Watson Text to Speech | IBM | |

| Amazon Polly | Amazon | |

| ReadSpeaker(旧Voice Text) | HOYA株式会社 | |

| AITalk | 株式会社エーアイ | ・VOICEROID ・A.I.VOICE |

| FutureVoice Cyayon | NTTテクノクロス株式会社 | |

| N2 | 株式会社KDDI総合研究所 | |

| コエステーション | コエステ株式会社 | |

| テクノスピーチ | 株式会社テクノスピーチ | CeVIO |

| FineSpeech | 株式会社アニモ | Megpoid Talk |

| ボイスソムリエ ネオ | ㈱日立ソリューションズ・クエスト | |

| CoeFront Cloud | 株式会社Yellston |

音声合成の活用例

音声合成はすでに至るところで使われていますので、いつの間にかみんな聴いてるはずです。特に次のような特性があるところは音声合成のメリットを十分に活かせるので、かなり広まっている状況です。

a.多言語対応

観光案内や美術館の音声ガイダンスなど外国人の利用を想定する場面では、各国の音声で読み上げてくれる音声合成のメリットが活かせます。また、電子辞書や翻訳端末などの翻訳音声も録音方式よりずっと手軽に音声を作成できます。

b.人工物(ロボット、アニメ、アバター、サイネージなど)

ロボットやアニメキャラなど、もともと人工物が話す場面は、むしろ音声合成した声が違和感なくぴったりです。ロボットが巷に溢れ、3Dより2Dに萌える若者が増える中、ロボットやアニメのキャラがしゃべる需要は非常に高くなっていると言えます。

c.電話を使った対応

電話音声は古くからの代表的な活用法ですが、音声合成技術が進歩して生身か機械か区別がつかなくないレベルになりました。でも、一生懸命話をして相手が機械とわかると「な〜んだ」って気持ちになるので、相手が生身の人間でないと分かる程度の自然な音声が好ましいかもしれません。

d.内容を変更できる

車内放送や構内放送、館内放送などでは、臨機応変に話す内容を変えることができる音声合成が便利です。特に多言語でアナウンスする場合は、録音した音声を流すよりずっと準備の手間が省けます。

e.テキストの読上げ

ホームページの内容を読み上げてアクセシビリティを向上したり、スマホに届いたメールをワイヤレスイヤホンで聴いたりするシンプルな目的でも幅広く使われています。また、電子書籍を音声で聴きながら読んだり、テレビのナレーションや動画のテロップ、e-Learning教材の音声などにもよく使われます。防災アナウンスや避難指示なども、緊急時に慌てないようにテキストを用意したり、指示を伝える人の安全を確保したりできます。

f.俳優や自分の声

音声合成は音声コーパスで自然な音声波形を作り出しますが、声質を誰かの声に似せる「音質変換」ができます。GANによる合成映像Deep Fakeの音声版ですね。このボイスチェンジャー的特徴を利用して、俳優の声でナレーションを入れたり、アイドルに歌わせることもできます。もちろん、自分の声を使うこともできますので、お葬式で故人の声で挨拶することもできます。誰かがリアルタイムでテキスト入力して、参列者と会話させたら場内騒然となるでしょうね。

表2に音声合成の主な利用例を示します。参考までにa〜fのどの特徴を活かせそうかチェックを入れています。こうして一覧で見ると、既に多くの利用がなされていること、これからさらに活用が広がりそうなことがわかります。

表2:音声合成の主な利用例

| 適用分野 | 利用シーン(例) | a | b | c | d | e | f |

|---|---|---|---|---|---|---|---|

| 車内/構内アナウンス | ・電車やバス、船などの車内アナウンス ・駅、空港などの構内アナウンス | ✓ | ✓ | ||||

| ロボット | ・コミュニケーションロボット ・掃除や洗濯機などの家電ロボット | ✓ | |||||

| ゲームやスマホアプリ | ・ゲームやスマホアプリのキャラ | ✓ | ✓ | ||||

| コールセンター | ・AIオペレータの音声 ・ヘルプデスク | ✓ | ✓ | ||||

| 音声応答 | ・FAQシステム ・問合せ応答 | ✓ | ✓ | ||||

| 防災 | ・防災アナウンス ・緊急音声通知 | ✓ | |||||

| 観光案内 | ・観光地の音声ガイド | ✓ | ✓ | ||||

| オーディオガイド | ・美術館などの館内 | ✓ | ✓ | ||||

| 館内アナウンス | ・映画館や病院などのアナウンス | ✓ | ✓ | ||||

| コンシェルジュ | ・ホテルや店舗の接客ロボット | ✓ | ✓ | ||||

| ホームページ | ・ワンクリックで音声読上げ ・アクセシビリティ向上 | ✓ | |||||

| ナレーション | ・テレビやラジオのナレーション | ✓ | |||||

| 車載スマートプレーヤー | ・カーナビの音声 | ✓ | |||||

| トレーニングシステム | ・車や飛行機の運転シミュレータ | ✓ | ✓ | ||||

| 翻訳デバイス | ・携帯型翻訳機 | ✓ | ✓ | ||||

| アバター | ・スマホやホームページのアバター ・ゆるキャラ | ✓ | |||||

| サイネージ | ・音声付きサイネージ | ✓ | ✓ | ✓ | |||

| ワイヤレスイヤホン | ・スマホ文章読上げ | ✓ | |||||

| 電子書籍 | ✓ | ✓ | |||||

| 電子辞書 | ✓ | ✓ | |||||

| e-Learning | ・音声付き教材作成 | ✓ | |||||

| 作業指示 | ・タブレットの作業指示を読上げ | ✓ | ✓ | ||||

| テストやアンケート | ・音声付きテスト ・音声付きアンケート | ✓ | |||||

| アイドルや自分の音声 | ・アイドルの声で歌う ・俳優の声でナレーション | ✓ | ✓ | ||||

| ウェアラブル端末 | ・メガネやウォッチなど | ✓ | |||||

| 地図アプリ | ・カーナビタイム for スマホ | ✓ | ✓ | ||||

| 拡大読書機 | ・視覚障害者向け | ✓ |

おわりに

私たちは、既にモノやキャラクターがしゃべるのに全く違和感がなくなっています。あまりに当たり前過ぎて、それらの声が音声合成で作られていることすら特に意識していないでしょう。一方で自然言語理解まだまだ課題が多い状況で、これが人間とAIのコミュニケーションのネックとなっています。次回は、このあたりの状況について解説します。

- この記事のキーワード