はじめに

本連載では、生成AIコミュニティ「IKIGAI lab.」に所属する各分野の専門家が、それぞれの視点から最新のAIトレンドとビジネスへの示唆を発信しています。本記事を通じて、皆さまが"半歩先の未来"に思いを馳せ、異なる価値観や視座に触れていただければ幸いです。

最近では生成AIを「どう安全に使い続けるか」「どう制度と運用を追いつかせるか」が検討されててます。利用率の上昇、教育現場での浸透、法整備の始動、シャドーAI対策、そしてコンテンツ産業の再編が同時進行しています。これらは独立した出来事ではなく、個人の利用が組織へ、組織の課題が制度へ、制度の遅れがリスクへと波及した結果です。

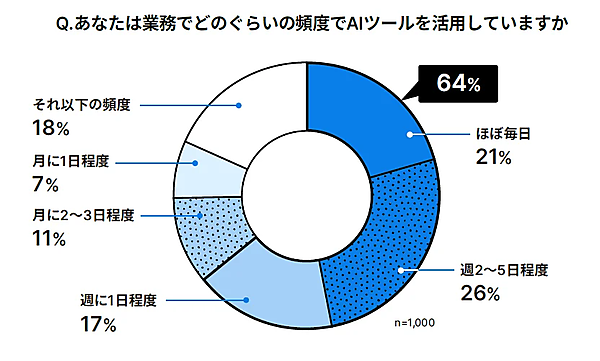

利用は定着、ボトルネックは"組織実装"

Notion Labs Japanの調査では、ナレッジワーカーの64%が週1日以上AIを利用し、2割超が毎日利用。個人利用は十分に進んだ一方、組織の活用環境は「整っている」49%、「整っていない」51%で二極化しました。また、組織内での利用拡大の最大の障壁はスキル・トレーニング不足(33%)です。

この課題に対して、ベリサーブは約2,000人の全社員向けにゲーム型学習プログラムを提供開始。ChatGPT Enterprise活用からDifyによるアプリ開発までを10ステップで設計し、業務都合で学習時間が取りづらい層にも対応しています。加えて、経営参謀の事例共有会では、AIを組織マネジメントに実装する実践知の共有が打ち出されており、導入フェーズから運用フェーズへの移行が鮮明です。

「スキル不足と運用設計」という課題は、職場だけでなく教育現場にも別の顔を見せています。そこにはさらに、依存や誤情報という固有の不安が加わります。

【参照】

「Notion、「日本企業における生成AI活用実態調査」を公開」(PR TIMES 2026/04/17)

「生成AIを約2,000人の全社員が自発的に楽しんで学べる「ゲーム型学習プログラム」を独自開発」(RBBTODAY 2026/04/15)

教育領域で進む「高浸透」と「不安の増幅」

株式会社A.ver(本社:東京都文京区 以下「武田塾」)が高校生を対象に実施した「生成AIと受験勉強の実態調査」では、受験でのChatGPT利用率が84.7%。一方で「情報の正確性」への不安は52.3%(前年比+13.3pt)、「すぐAIに頼るようになった」が58.6%でした。活用意向は高いのに、依存や誤情報への警戒も増えているという、結果になりました。

保護者側の調査(花まる教育研究所)でも、子どもの生成AI利用に前向きな親は54.3%いる一方、55.1%が使わせ方に悩み、家庭内で十分に話し合えていない割合が高いことが示されました。教育現場のテーマは、利用禁止か容認かではなく、「どの場面で、どこまで、どう検証するか」という運用設計に移っています。

「誤情報への懸念」と「権利侵害への懸念」は連続した課題として考えられています。権利侵害の懸念については制度的な対応が追いついていない現状があります。

【参照】

「【生成AIと受験勉強の実態調査2026】ChatGPT利用率が84.7%で首位!一方で「情報の正確性」への不安は52.3%と2025年に比べ13.3ポイント増」(PR TIMES 2026/01/23)

「5割の親が子どもの生成AI利用に前向きも、約半数が使わせ方に悩み=花まる教育研究所調べ=」(ICT教育ニュース 2026/04/16)

法整備は"ようやくスタートライン"

朝日新聞記事によれば、法務省は生成AIによる肖像・声の権利侵害に関して有識者による検討会を立ち上げ、民事責任を問える範囲の法的整理に乗り出した。 平口法相は「深刻な問題」とし、生成AIを想定しないパブリシティー権や、不明確な声の権利の保護、ディープフェイク被害への不法行為の適用範囲を整理しました。

この動きに対し、声優の緒方恵美さんが「ようやくスタートライン」と反応。技術の普及速度に法制度が追いつくための初動として、今後のガイドライン運用が注目点です。

技術進化が激しくルールが「後追い」になっているのは法整備だけでなく、企業内のガバナンスでも同じです。そのため、制度的空白が続く中、組織の情報漏洩のリスクが最も先鋭化しています。

【参照】

「生成AIによる権利侵害、法務省が法的整理へ 有識者の検討会を設置」(朝日新聞 2026/04/17)

「緒方恵美、生成AI問題を政府が法的整理へ「ようやくスタートライン」「見守ります」」(日刊スポーツ 2026/04/19)

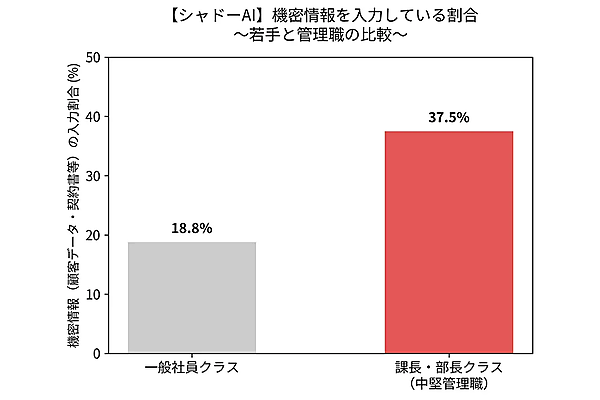

企業リスクの中心はシャドーAIと機密情報管理

Forbes JAPANの調査では、非公認AIに機密情報を入力している層が約23%(4人に1人)で、管理職は一般社員より約2倍高リスクという調査結果が示されました。また、TECH+記事では、SaaSとAI連携が進む中で、情シスが全体を把握しきれない現実を報告しています。

ここで重要なのは、単純な全面禁止では逆効果になりやすい点です。TECH+が示すように、管理は「導入時の点検」から「継続監視の運用」へ移行しつつあります。安全な公式ルートを整備し、現場のスピードと統制を両立できるかが競争力を左右します。

内部リスクをコントロールできた組織の先に見えてくるのが、生成AIがもたらす産業の変化です。

【参照】

「生成AIに機密情報を教える管理職は4人に1人 一般社員より2倍高いリスク」(Forbes JAPAN 2026/04/18)

「生成AI時代に崩れるSaaS統制 - 見えないシャドーITと情シスの新たな役割」(マイナビニュース 2026/04/16)

産業インパクトは"多言語化"と"創作領域"で加速

MavericksのNoLangは韓国語UI対応で4言語体制へ拡張し、台本・ナレーション・字幕まで韓国語で完結できる制作環境を提示しました。これは、生成AIの価値がモデル性能だけでなく「現場の摩擦をどれだけ減らせるか」に移ったことを示します。

同時に、Forbes JAPANの記事ではAI生成楽曲が複数国のiTunesで首位を獲得する一方、著作権訴訟や権利団体の反発が継続。技術的には可能でも、権利処理と社会受容が事業拡大の制約条件であることが明確です。

さらにAnthropicのProject Glasswingは、防御目的で活用し、重要ソフトウェアの脆弱性発見・修正を加速する先端モデルを発表しました。AIが攻撃リスクを高める一方で、防御能力も引き上げるという「両義性」が、2026年の実相と言えます。

【参照】

「株式会社Mavericksは、動画生成AI「NoLang」のUIを新たに「韓国語」に対応。日・英・越に続く4言語目として」(PRTIMES 2026/04/19)

「AIが生成した楽曲、米国など複数の国のiTunesチャートで首位に」(ForbesJAPAN 2026/04/18)

「Project Glasswing: Securing critical software for the AI era」(Anthropic)

まとめ

本記事で見てきたのは、生成AIの活用がもはや一部の先進層だけのものではなくなり、社会全体の前提に近づきつつある姿です。個人利用は着実に広がり、教育現場でも浸透が進み、企業では実務への組み込みが始まっています。その一方で、誤情報への不安、権利侵害への懸念、シャドーAIによる情報漏洩リスクなど、活用の広がりに比例して「運用の難しさ」も表面化してきました。

つまり、生成AIをめぐる競争の軸は、導入そのものから、どう使いこなし、どう制御し、どう社会や組織の仕組みに組み込むかへと移っています。利用率の高さだけでは、もはや競争優位にはなりません。教育、ガイドライン、権利処理、情報統制といった周辺条件まで含めて設計できるかどうかが、成果の差を分ける段階に入っています。

今後は、技術の進化に制度や組織運営が追いつけるかではなく、追いつかないことを前提に、どう先回りして運用を整えるかにあると考えます。生成AIは万能な解決策ではありません。しかし、現場に合わせた実装と継続的な見直しができる組織にとっては、大きな生産性向上と新たな価値創出の起点になります。

2026年のいま問われているのは、AIを使うかどうかではなく、AIとどう共に働く環境を設計するか。その実装力そのものが、次の競争力になっていくのではないでしょうか。

- この記事のキーワード