SIGGRAPH Asia 2025でのAdobeのセッションに続いて、同様にシアターを使って1時間のプレゼンテーションを行ったNVIDIAのスポンサーセッションを紹介する。Adobeと同じように展示ブースにはコストをかけずに、このセッションにリソースを集中させた形になっていた。

プレゼンテーションを行ったのはNVIDIA ResearchのDirector、Shalini De Mello氏だ。

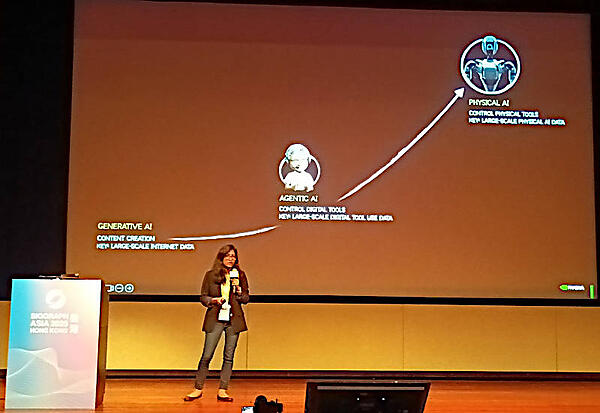

NVIDIAは生成AIからエージェンティックAIという進化の先にPhysical AI(物理的な実体を持ったAI、物理AI)が来ると信じていることを説明。

これを自動運転のWayveがEmbodied AI(身体性AI)として訴求していたものと同じ意味であるとすれば、Wayveのキーノートで繰り返し訴えていた「シミュレーションが物理的な実体を持つAIシステムの開発の要点」であることと重なるメッセージである。Wayveはシミュレーションに加えて、実験のためのデータを合成することの必要性を強く訴えていた。

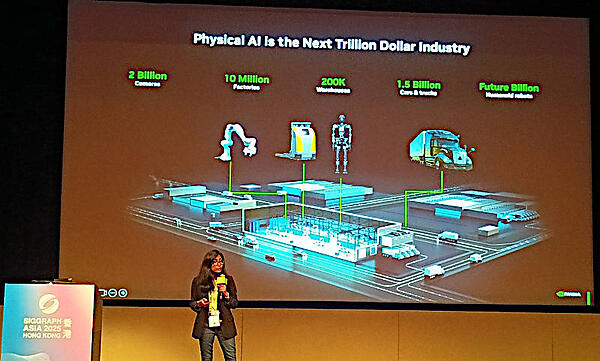

ここではコンピュータの中だけで実行されるAIではなく、実際にモノを動かす産業の至るところに物理AIが応用されることで大きな価値が生まれることを訴えた。20億台のカメラ、1000万ヶ所の工場、20万ヶ所の倉庫、15億台の車輛という数値がどこから来たのかは明らかにされなかったが、NVIDIAは実際に多くの産業において物理AIが使われるようになることを想定しているということだろう。

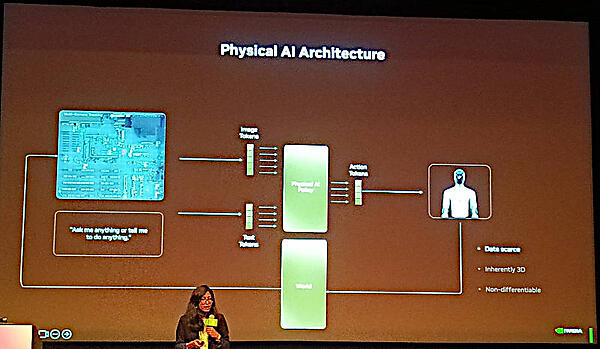

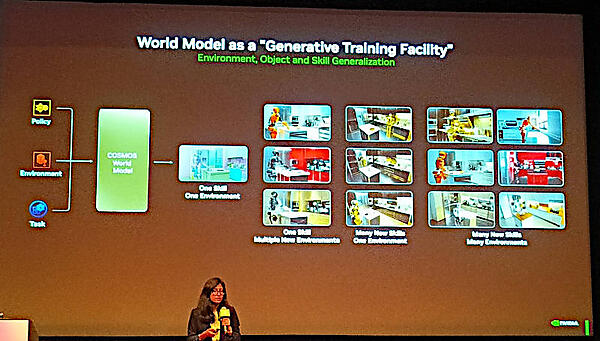

次に、その物理AIがどのようなアーキテクチャーで構成されるのかを説明。ここではカメラで獲得したデータ(床の上の箱の写真)をイメージトークンとして使い、それに対して言語によるトークン、例えば「目の前の箱を移動しろ」というテキストトークンを使い、それをワールドモデルの中でシミュレーションした上で実際に物理のロボットが操作、その結果をワールドモデルに反映し、結果をリワードとして返すことでその操作が良い選択だったのかを反映して、次の操作のためのループが繰り返されると説明。認識→操作→評価というループを繰り返すことで、ロボットの行いが改善されていくという原理である。

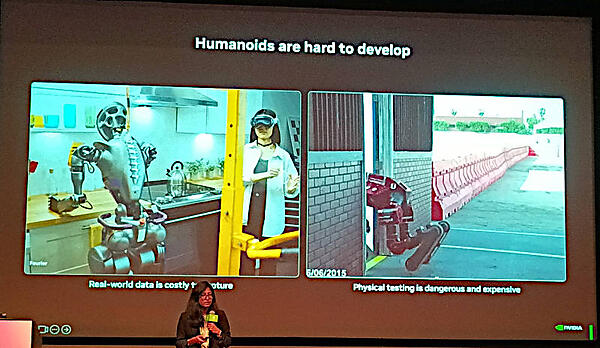

しかしヒューマノイドの開発は多くの失敗を重ねてきたとして、成功するためにはグラフィックスと生成AIが必要であることを説明した。

ロボットの学習のために実体でのデータを収集するのはコストがかかり、実際にロボットをテストすることは危険でこれにも多大なコストが必要となることを示した。

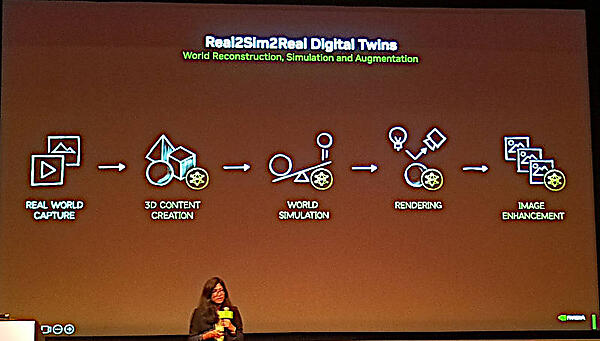

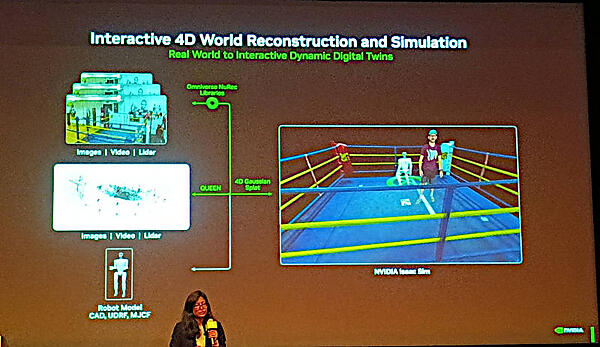

ここではリアルな世界を認識したうえで、それをシミュレートされた世界として構築することが必須となると説明。ロボットが認識する世界をリアルな状況に限りなく近く再現することが必要であることが強調されている。Real2SimやSim2Realに関しては論文が発表されているが、リアルな世界をシミュレーションに移したうえで再度、リアルな世界での操作に反映するという発想(Real2Sim2Real)が物理AIを実現するためのNVIDIAとしての解答ということになる。

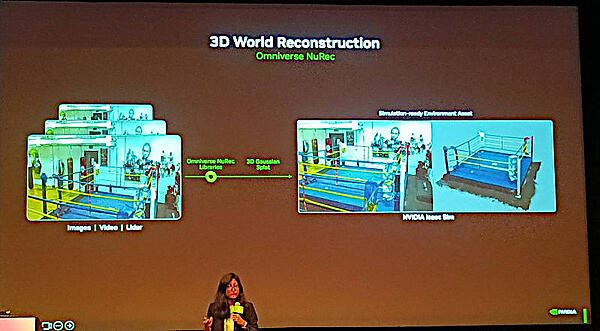

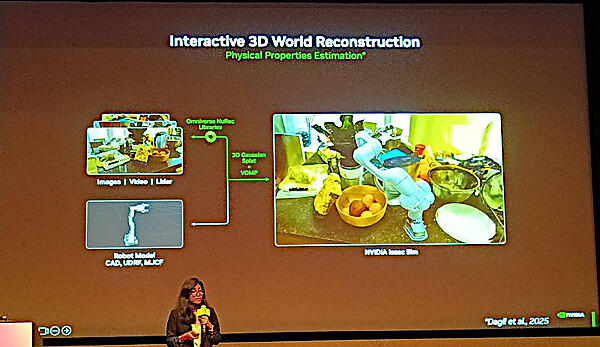

3次元の世界を構築するためには、カメラや深度センサーからのデータを3次元に再構成する必要がある。そのために使われるのは3D Gaussian Splattingだ。

ここでは撮影されたデータから3次元の世界を構築し、その中にロボットを置いてモノを掴む行動をシミュレートする方法が紹介されている。

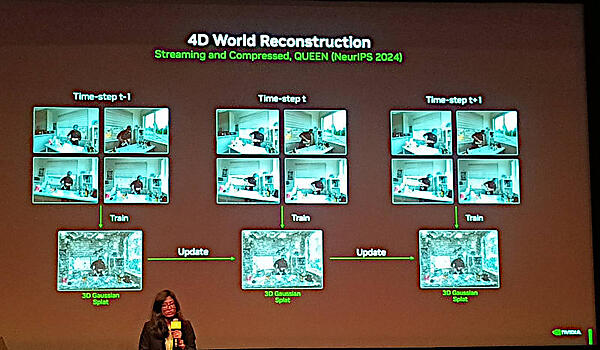

また単に3Dの座標だけではなく時間のデータ、つまりドローンの管制システムでも言及されていたX軸、Y軸、Z軸に加えて「いつそれが起こった(起こる)のか」というT(Time)軸、すなわち時間軸が必要だと説明した。

このスライドで引用されているQUEENはNVIDIAのホームページにも解説があるが、元となった論文はNuerIPS 2024として2024年12月にバンクーバーで開催された学会で発表された「QUEEN: QUantized Efficient ENcoding of Dynamic Gaussians for Streaming Free-viewpoint Videos (NeurIPS 2024)」だ。この論文にはこのセッションのプレゼンターであるDe Mello氏も著者として明記されている。NVIDIAのページは以下を参照して欲しい。

●参考:QUEEN:QUantized Efficient ENcoding of Dynamic Gaussians for Streaming Free-viewpoint Videos

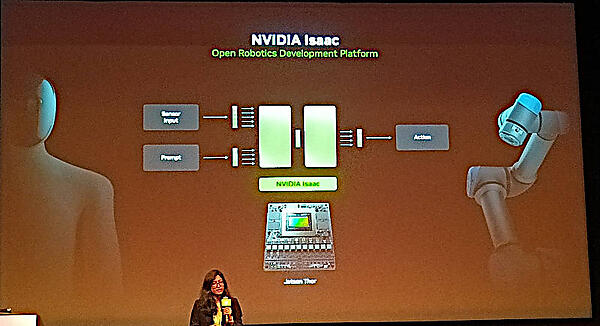

このようなシステムを構築するためのNVIDIAのソリューションがNVIDIA Isaacであると解説した。

Isaacについては以下の公式ページを参照されたい。

●参考:NVIDIA Isaac Sim

Isaacの使用例としてボクシングのリングの中に人間とロボットがいる例を紹介。ここではデジタルツインとして世界がシミュレートされている。

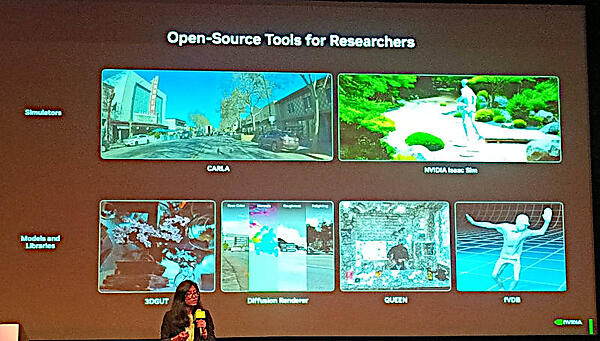

他にも外の空間をシミュレートするためのライティングのレンダリングなどが備わっていることを紹介。しかしSIGGRAPHの参加者の大部分が学生であることを意識してか、オープンソースのツールなども紹介した。

ここではNVIDIAのQUEENもオープンソースとしてGitHubで公開されている。

●参考:https://github.com/nvlabs/queen

最後にNVIDIAのプロダクトでデジタルツインとしての物理AIのシミュレーションが可能になっているという自社の宣伝を行った上で、自身のリサーチチームを紹介。AI-Mediated Reality and Interaction Research groupというのが正式の名称らしい。以下のページにメンバーの紹介が掲載されている。

●グループの紹介ページ:NVIDIA AI-Mediated Reality and Interaction Research Group

NVIDIAのセッションは、デジタルツインを使ったシミュレーションが物理AIの要点であることを強調したものとなった。参加者の多くは学生と研究者であることを考えると、短期の利益ではなくNVIDIAの業界での優位性を示すためのプレゼンテーションであったと言える。スポンサーとしては展示ブースではなくそれぞれのセッションに今回の予算を使い切ったという方針だろう。ちなみにNVIDIAのIsaacもシミュレーションに必要なアセットである3次元のオブジェクトについてはOpenUSDのサポートを表明しているため、Adobe Substance 3Dで作成した背景などを使ってIsaac上でシミュレートされた世界を構築することが可能になる。