はじめに

本連載は、生成AIコミュニティ「IKIGAI lab.」で活動しているメンバーでお届けしています。専門家としての知見を持ちながらも、それぞれ少しずつ異なる視点で、最新のAIトレンドやビジネスへのヒントをお届けしています。記事を通して、“半歩先の未来”を一緒に思い描き、さまざまな価値観や視点に触れていただけたら嬉しいです。

前回の記事「【ビジョンなき導入の末路】データが暴く日本企業の課題と次の一手」の最後で触れたように、OpenAIが2025年11月12日(米国時間)に「GPT-5.1」を正式リリースしました。GPT-5.1ではGPT5の時に発生した炎上 ―SNS上で展開された#keep4oや#4oforeverといったハッシュタグや「GPT-4oを返して」という切実な声― を教訓に「温かさ」や「心地よい会話」を実現できるようにしました。

アップデートを発表したのはOpenAIだけではありません。GoogleとAnthropicも相次いで新モデルをリリースしています。

今回は、この1か月に最新モデルがリリースされた、

- OpenAI GPT-5.1

- Google Gemini 3(+Nano Banana)

- Anthropic Claude Opus 4.5

GPT5.1のアップデート総まとめ

【出典】「GPT-5.1: A smarter, more conversational ChatGPT」(Open AI 2025/11/12)

2025年11月にリリースされた関連するアップデートは、概ね以下の通りです。

- 2025年11月12日 GPT5.1リリース

- 2025年11月13日 グループチャット機能リリース

- 2025年11月19日 ChatGPT for Teachersリリース

- 2025年11月19日 GPT-5.1-Codex-Maxリリース

- 2025年11月24日 ショッピングリサーチリリース

GPT-5.1 Instant/Thinking:炎上から「温かさ」へ

GPT-5.1の公式ブログでは、ユーザーからのフィードバックとして

「賢いだけでなく、心地よく会話できる存在であってほしい」

これまでのGPT-5では「ぶっきらぼう」「急に冷たい言い方になる」といった指摘も一定数ありました。GPT-5.1では、特に以下の点が改善されています。

Instant- 既定トーンが「より温かく、会話的」

- 指示の理解力は維持しつつ、チャット感が増した

- ふるまい(トーン/語調)を調整することも可能に

- 複雑なタスクに対してより粘り強く推論

- 簡単なタスクはむしろ高速化

押さえておきたいポイントは「性能が上がった」だけでなく「ふるまいが調整しやすくなった」という点です。ビジネス現場で「ちょっとカジュアルに」「逆にもう少しフォーマルに」といったニュアンス調整が必要なとき、この変化は地味に効いてくるでしょう。

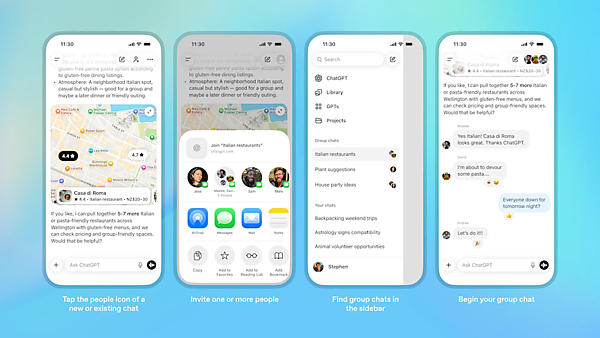

グループチャット機能:AIを“場”に連れてくる

11月13日にパイロットとして始まり、20日頃より順次ユーザーに展開されているのがグループチャット機能です。以下のような特徴があります。

- 最大20人+ChatGPTが同じスレッドで会話

- 個々のユーザーのメモリや設定は共有されない(プライバシー配慮)

- メッセージ内で「ChatGPT」と呼びかけることで、応答を促すことが可能

- プロジェクトのブレスト、旅行計画、イベント企画などを想定ユースケースとしている

SlackやTeamsに「AIボット」がいる世界はすでに一般的ですが、ChatGPT側のUIでここまで“場”に最適化したのは大きな変化です。

現場目線で言うと、

- 小規模プロジェクトなら「とりあえずChatGPTのグループチャットを立てる」

- 会話ログとAI回答が1つのタイムラインにまとまる

【出典】「ChatGPTでのグループチャットのパイロット提供を開始」(Open AI 2025/11/13)

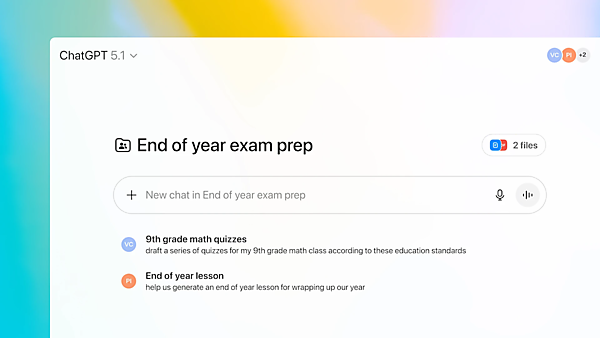

ChatGPT for Teachers:教育特化の「安全なワークスペース」

11月19日に発表された「ChatGPT for Teachers」は、その名の通り「教員向けのChatGPT」です。以下のような特徴があります。

- GPT-5.1 Auto(Unlimited)

- 検索、ファイルアップロード、各種コネクタ

- 授業資料や生徒情報を扱うための専用ワークスペース

- 同僚とのコラボレーション機能

- 米国では2027年6月まで無料提供予定

「教育向けモデル」というよりも「教育現場向けの専用環境+権限設計」という位置づけです。今後、同様の“業界別ワークスペース”が出てくる可能性は高く、ChatGPT for Teachersはその先駆けと言えます。

この分野ではMicrosoftやGoogleが長年の実績を持つため、OpenAIが教育現場でどこまで存在感を高められるかが今後の焦点となりそうです。

【出典】「A free version of ChatGPT built for teachers」(Open AI 2025/11/19)

GPT-5.1-Codex-Max:長時間タスクに挑む”新世代コーディングモデル”

同じく11月19日に発表されたのが「GPT-5.1-Codex-Max」で、OpenAIが「長時間タスクもこなせるコーディング特化モデル」と位置づける最新モデルです。

特徴的なのは、コンテキスト上限に近づくと重要な文脈だけを自動整理するコンパクション機能を備え、セッションを維持したまま作業を続行できる点です。この仕組みにより、OpenAIの内部評価では24時間以上にわたる連続タスクを完遂できたと報告されています。

実務的には、次のようなユースケースが想定されます。

- 大規模リポジトリの全面リファクタリング

- テストコードの一括自動生成と修正

- 既存サービスのAPI改修に合わせたコードパターンの置き換え

- 脆弱性診断やセキュリティ修正の自動提案

【出典】「Building more with GPT-5.1-Codex-Max」(Open AI 2025/11/19)

ショッピングリサーチ機能:買い物の“最後の一押し”までAIが担当

最後の「ショッピングリサーチ機能」については、少しだけ説明が必要かもしれません。

ショッピングリサーチでは、

- 「5万円以内でテレワーク向けの27インチモニタを探したい」

- 「中学生の甥っ子に贈るガジェットでおすすめを知りたい」

これまでも「ショッピングリサーチ機能」と同等なことはChatGPTで行うことは可能でした。

【出典】「【保存版】センスNo.1のAIは? 5つのDeep Researchを徹底比較!」(NEWS PICKS 2025/3/13)

ジェネトピ(Generative AI Topic)の動画内でまさにショッピングリサーチ的な使い方をしていますが、実はこれまでもChatGPTでは「ショッピングアシスト機能」が導入されており、ショッピングの提案を行うことができていました。ただ、入力したプロンプトによってはこの機能が有効にならなかったりするということや、レガシーモデル(GPT-4o、4o-mini)も順次廃止されるということから、GPT-5.1 miniにアップグレードするとともにリニューアルされたものと考えてよさそうです。

専用のモードとなることで、簡単かつ網羅的に情報の収集と比較を行うことが可能です。これまで予算や好みはプロンプトで入力しなければなりませんでしたが、選択肢として提示されるため選ぶだけでより簡単にリサーチを行うことが可能になりました。

また、将来的には「Instant Checkout」機能との連携を通じて、ChatGPTから直接購入できるようになる予定です。これまでは商品をクリックすると、そのショッピングサイトに遷移して購入というステップでしたが、ショッピングがChatGPT内ですべて完結することになります。

【出典】「Introducing shopping research in ChatGPT」(Open AI 2025/11/24)

日本のECがどこまでこのエコシステムに乗るかは未知数ですが、「AIがリサーチして、そのまま“買っておいてくれる”」というUXは、少なくとも海外では2025年のホリデーシーズンから本格的に試され始めています。

他の内容については、Impress社「窓の杜」で分かりやすく簡潔にまとめられているので、そちらを参照してください。

【参照】- OpenAIが「GPT-5.1」を発表 ~温かみを増した「Instant」賢くなった「Thinking」の2モデル【11月20日追記】

- 「ChatGPT」にグループチャット機能が追加、最大20人がWebとモバイルで会話

- OpenAI、「ChatGPT for Teachers」を発表 ~2027年6月まで米国で無償提供

- OpenAI、「GPT-5.1-Codex-Max」を発表 ~新しいソフトウェア開発特化AIモデル

- OpenAI、買い物用に訓練された「GPT-5 mini」を全ユーザーに無償提供、ホリデーシーズン中

Googleによる最新モデルの公開

【出典】「Introducing shopping research in ChatGPT」(Google The Keyword 2025/11/18)

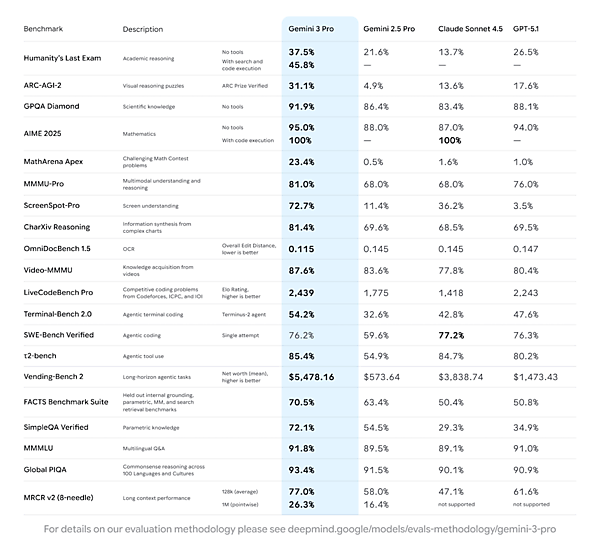

まず、OpenAIに呼応する形で大型アップデートを行ったのがGoogleです。OpenAIがGPT-5.1をリリースしたあと、それに呼応するように Googleも最新モデルとなる「Gemini 3」をリリースしました。最初にリリースされたのは「Gemini 3 Pro」ですが、驚くべきはその性能です。

既存モデルのGemini 2.5 Proを超えているだけではなく、ほぼすべての項目でライバルの最新モデルを凌ぐスコアとなっています。

ここからは、Gemini 3 Proと画像生成モデル「Nano Banana Pro」(Gemini 3 Pro Image)について、もう少し踏み込んで見ていきます。

Gemini 3 Pro:1Mトークン時代の“長文×マルチモーダル頭脳”

1Mトークンのコンテキストウィンドウ

Gemini 3 Proの最大の特徴は、100万トークン(1M tokens)のコンテキストウィンドウです。Google自身が「約1,500ページの文書、あるいは3万行のコードを一度に扱える」と説明しており、

- 仕様書やマニュアルの“冊子”を丸ごと読み込む

- 複数の設計書+議事録+メールログをまとめて解析する

- 社内Wikiの一部をそのまま投入してナレッジを抽出する

日本企業の現場感で言うと、

- 数百ページある契約書・運用手順書・構成図の説明文を全部突っ込んで「今回の変更による影響点を洗い出して」と頼む

- 1〜2年分のプロジェクト議事録を読み込ませて「この案件のボトルネックになっていた要因を整理して」と指示する

マルチモーダル統合と次世代のAI統合開発環境「Antigravity」

Gemini 3 Proはテキストだけでなく、画像・音声・動画・PDF・コードリポジトリなど、さまざまなソースから情報を取得できます。

公式ブログでは、Googleの次世代AI IDEである「Google Antigravity」を通じてGemini 3を核にした“エージェント主導型の開発ワークフロー”が紹介されています。

Antigravityは、従来の「人間がコードを書くIDE」ではなく、AIエージェントが主体となって仕様理解→設計→コード生成→ブラウザ操作→UIモック作成まで行う、新しい形の統合開発環境です。ユーザーはエージェントに指示を与え、作業内容を確認しながら進めるため、開発プロセスそのものが“agent-first”へと再設計されています。

そのデモでは、以下のような流れが示されています:

- Gemini 3が仕様書を読み取り、必要な機能や実装方針を自動で整理する

- Gemini 2.5のComputer Useモデルを用いて、ブラウザ操作や環境構築をエージェントが自律的に実行する

- Googleの画像生成モデル「Nano Banana」を使い、UIイメージや画面デザインのモックアップを生成・編集する

「要件を投げると、AIが仕様を理解して、コードを書いて、ブラウザ上で動作確認し、UIのビジュアルも用意してくれる」

という「AIが開発全体を回す」新しい開発パラダイムを象徴するデモとなっています。

Nano Banana Pro:図解・インフォグラフィックに強い画像生成モデル

続いて、画像生成モデルの「Nano Banana Pro」です。正式には「Gemini 3 Pro Image / Nano Banana Pro」として紹介されています。この名称から分かるように、プロンプトの解釈にはGemini 3がベースモデルとして採用されています。

Googleの公式ブログやDeepMindのモデルページによると、Nano Banana Proは主に次のような用途を想定しています。

- アイデアの可視化

- プロトタイピング用のUIモック

- プロダクトのコンセプトイラスト

- データからのインフォグラフィック生成

- データを渡して「分かりやすい図解にして」と依頼

- グラフ+説明文を含むビジュアル資料

- 手書きメモ → 図表化

- ホワイトボードの写真からきれいな図表へ

- 手書きのネットワーク構成図を清書

- テキスト入り画像(多言語対応)

- ポスター、チラシ、プレゼンのタイトル画像

- 表やラベルを含んだ技術資料の図解

- 最大4K解像度の高精細画像生成

特に「テキスト入り」「図表」「インフォグラフィック」に強い点が、他の画像生成モデルとの大きな違いです。日本語のテキスト入り画像にも対応している他、最大14のイメージをもとに一貫性を保ったまま1枚の画像として生成できることから、例えば次のような使い方が見えてきます。

- 社内向けの新サービス説明資料の図解ページを文章+箇条書きから自動生成

- ネットワーク構成の概要図を手書きから清書

- マーケ資料向けのバナーやキービジュアルをテキスト込みで一気に量産

- 教育現場で授業内容を図解インフォグラフィックとして生徒に配布

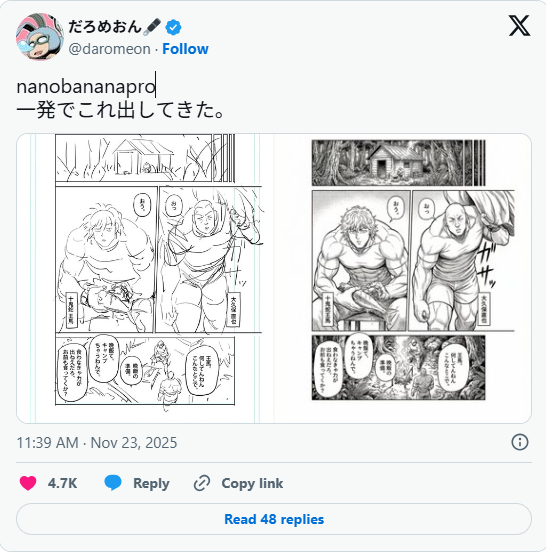

「Illustratorを開く前に、まずNano Bananaに投げてみる」というワークフローが現実的になりつつあります。中でもマンガ業界ではその能力の高さに注目が集まりつつあります。

【出典】「だろめおん(@daromeon)」(X 2025/11/23)

現時点でNano Banana Proがどうマンガ制作に利用されていくのかは未知数ですが、これまでアシスタントが担ってきた作業を一部を補助・代替する可能性があります。

マンガ制作には

- 発想(ネーム)

- デザイン

- 作画(線画)

- 背景

- 効果

- レイアウト

- 修正

結果としてマンガにも相性が非常に良いものになったのではないかと思われますが、プロの作画工程をどこまで代替できるかは今後の検証が必要です。制作フローの一部を補助する“新しい道具”として、マンガ制作との相性は今後さらに注目されそうです。

Anthropic Claude Opus 4.5:静かに最強化した第三勢力

【出典】「Introducing Claude Opus 4.5」(Anthropic 2025/11/25)

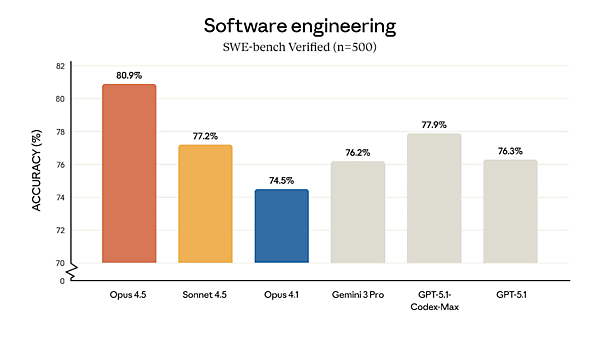

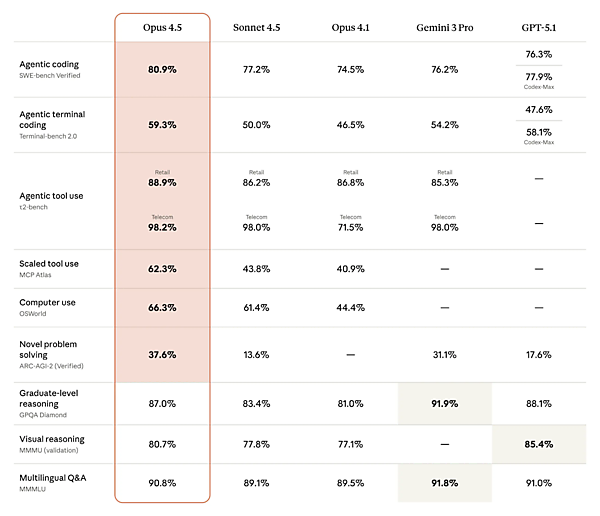

2025年11月24日、Anthropicが「Claude Opus 4.5」をリリースしました。公式によると「コーディング、エージェント、コンピュータ利用において世界で最も優れたモデル」ということで、コーディング能力は群を抜いています。

【出典】「Introducing Claude Opus 4.5」(Anthropic 2025/11/25)

- Evalsベンチマークの多くでGPT-5.1と肩を並べる

- 推論の粘り強さはClaude系らしく非常に安定

- コーディング能力も大幅強化(初期のCodex-like動作を復活)

- 長時間のエージェントタスクに対応

ソフトウェアエンジニアリングだけがOpus 4.5の進化領域ではありません。視覚認識、推論、数学などあらゆる能力が大きく向上しており、複数の分野で最新の最先端モデルとして位置づけられています。

【出典】「Introducing Claude Opus 4.5」(Anthropic 2025/11/25)

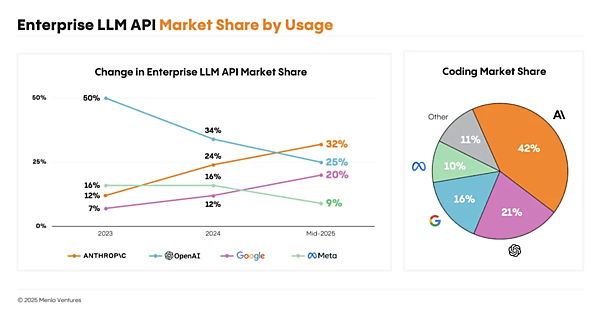

ソフトウェアエンジニアリングに強いAIということで企業利用も加速しており、ある調査によればAnthropicはエンタープライズAI市場で32%のシェアを獲得しており、OpenAIとGoogleのシェアを上回っています。

【出典】「2025 Mid-Year LLM Market Update: Foundation Model Landscape + Economics」(MENLO VENTURES 2025/1/31)

それぞれのAIの使い分け

この1ヶ月で出揃った3社の方向性は、非常に対照的です(【注】ここでの方向性は公開情報をもとにした筆者の独自見解です):

| 社名 | 方向性 | 特徴 |

|---|---|---|

| OpenAI | バランス型 (会話・推論・コーディング・検索・エージェント) | GPT-5.1 Instantの会話力、GPT-5.1 Thinking/Codex-Maxの長時間コーディング |

| 量と統合処理 (長文・マルチモーダル・1M tokens) | 大量の資料・PDF・コードを跨いだ解析、Antigravity+Nano BananaによるUI/図解生成 | |

| Anthropic | 品質+コーディング (安全・安定・エージェント) | Claude独特の慎重で精度の高い推論、Opus 4.5/Claude Codeによる堅牢なコーディング支援 |

ここから、GPT-5.1/Gemini 3/Opus 4.5の使い分けを考えてみます。

ビジネス文書・企画・メール → GPT-5.1

Instantの自然さとプロンプトへの忠実性が圧倒的に扱いやすい。企画書、議事録、契約書ドラフト、日英メールなど「テキスト中心の実務」はまずGPT-5.1から使ってみるのがおすすめです。プロンプト例などの情報も得やすいのも扱いやすい1つの理由になります。

大規模資料の理解・ナレッジ整理 → Gemini 3 Pro

PDF・コード・議事録・仕様書などを“丸ごと”放り込みたいときの最適解。1Mトークンのコンテキストを活かし、

- 過去の議事録+設計書+チケットをまとめて読み込み

- 課題の共通パターンやリスクを抽出

精密な推論・安全性・コード修正 → Claude Opus 4.5

Claude Opus 4.5は、

- 仕様の読み込み・要件定義

- 条件の解きほぐし・論点整理

- 既存コードのバグ調査・部分的な修正提案

- 既存プルリクエストのレビュー

- 影響範囲を意識した修正案

- 安全性を重視したリファクタリング

図解・資料向けビジュアル → Nano Banana(Google)

図解・インフォグラフィック・UIモックなど、資料作りのビジュアル面の生産性はNano Bananaが群を抜いています。

- 提案書の構成図

- ネットワークトポロジ

- マニュアルの図解

- マーケ用バナーやタイトルページ

コード大量生成・長時間エージェント → GPT-5.1 Codex-Max+Claude Opus 4.5

- GPT-5.1 Codex-Max

- 24時間クラスの長時間エージェント

- 大量生成・大規模リファクタリング・自動テスト生成など“量をこなす系”が得意

- Claude Opus 4.5(+Claude Code)

- 仕様読み込み→慎重な修正案→プルリクエスト生成のような、品質と安全性を重視したコーディングタスクに強い

- 「この変更、本当に大丈夫?」という確認役・セカンドオピニオンとしても相性が良い

がっつり一晩まるごと回すバッチ的なコード生成はGPT-5.1 Codex-Max、壊すと怖い本番系リポジトリの修正やレビューにはClaude Opus 4.5+Claude Codeというように、“粗く書くAI”と“慎重に見るAI”を分けて使うと現場感に合うのではないかと思います。

おわりに

2025年11月の3社のリリースから、何が見えてくるでしょうか。

AIが“検索”から“エージェント”へ

2025年は「AIエージェント元年」と呼ばれています。Shopping Researchに現れているように、この流れはどんどん加速していくでしょう。

AIが“個人の道具”から“チームの場”へ

グループチャットが示すように、今後個人利用からチーム協力に必要な存在になっていく可能性があります。今は会議内容の要約や議事録作成程度ですが、一参加者として会議に参加する日も近いでしょう。

AIが“文章生成ツール”から“業務OS”へ

テキスト、図解、コード、ブラウザ操作、推論。これらは単機能ツールではなく、業務全体における接着剤としての役割を担うまでに進化しつつあります。

AIが「何ができるか」から「どう組み合わせるか」の時代へ突入していると言えるのではないでしょうか。

【出典】「TPU「Ironwood」の一般提供開始と推論時代を支える新しいAxion VMを発表」(Google Cloud 2025/11/7)

Gemini 3の学習にはGoogleが開発した最新世代のAIアクセラレーター「TPUv7」(コードネーム:Ironwood)が使用されています。トランスフォーマーの計算に特化した専用チップで、行列演算性能と電力効率の高さが特徴です。

GPU(特にNVIDIAのH100/H200/B200)に比べて市場普及率は限定的ですが、TPUは巨大モデルの訓練・推論をスケールアウトで効率よく処理することに特化しています。

- AI計算(MatMul)に最適化された専用アーキテクチャ

- 数千〜数万規模のクラスタで高効率に動作

- 性能あたりの電力効率(Performance per Watt)が高い

- JAX/XLAなどGoogleの研究エコシステムと深く統合

*XLA: TensorFlow→TPU最適化のために開発された最適化コンパイラ

特に、生成AIでは行列演算(MatMul)が計算全体の90%以上を占めると言われているため、専用設計のTPUは極めて合理的です。一方、NVIDIA GPUは汎用性と開発者エコシステムが圧倒的で、PyTorch+CUDAを中心とした世界標準の地位を維持しています。

- 「巨大モデルを高速に学習する」にはTPU

- 「研究・実験・プロダクト開発の柔軟性」にはGPU

GeminiシリーズはあえてTPUに最適化することで、Googleらしい“巨大モデルの高速進化”を実現していると言えるでしょう。

【参照】「TPU「Ironwood」の一般提供開始と推論時代を支える新しいAxion VMを発表」(Google Cloud 2025/11/7)

「TPUとは? CPUやGPUとの違いや適している作業などを解説」(株式会社SHIFT 2025/11/27)